WORKSHOP 11: ARIMA model checking 1) Unemployment Data Step 1: Compute the ACF, PACF, and Spectrum of the estimated residuals. Is there any indication of a 'forgotten' process? Re-identify the ARIMA model (if necessary) and re-estimate the parameters (and forecast). Important : do not apply any new model estimations/forecasts to the residuals (use the original data instead).

Welcome message from author

This document is posted to help you gain knowledge. Please leave a comment to let me know what you think about it! Share it to your friends and learn new things together.

Transcript

WORKSHOP 11: ARIMA model checking1) Unemployment DataStep 1: Compute the ACF, PACF, and Spectrum of the estimated residuals. Is there any indication of a 'forgotten' process? Re-identify the ARIMA model (if necessary) and re-estimate the parameters (and forecast). Important: do not apply any new model estimations/forecasts to the residuals (use the original data instead).

De ACF en PACF verlopen gelijkaardig, wat er op wijst dat er niet langer sprake is van een patroon. Dit wordt bevestigd door de (partiële) autocorrelatiecoëfficiënten. Deze coëfficiënten, zowel de seizoenale als niet-seizoenale zijn niet buiten het betrouwbaarheidsinterval gelegen, waardoor er van een (S)AR- of (S)MA-patroon geen sprake kan zijn.

Wanneer het Cumulative Periodogram en het Spectrum worden bekeken, blijkt dat er geen lange termijn noch een korte termijntrend aanwezig te zijn. Er vallen wel nog enkele (weinig uitgesproken) ‘trappen’ te determineren, maar van seizoenaliteit is overduidelijk geen sprake. De voornaamste vaststelling is dus dat de residu’s geen trendmatig verloop vertonen. Bovendien is het Spectrum ook volledig binnen de grenzen bepaald door het betrouwbaarheidsinterval gelegen.

Step 2: Examine the following diagnostics of the residuals: variability, histogram, rootogram, entropy concentration, skewness & kurtosis, and percentiles. Are the residuals normally distributed? What do you think would happen if they are not normally distributed? Does this influence your analysis?

Een eerste manier om na te gaan of de residu’s normaal verdeeld zijn, is gebruik te maken van een histogram. Voor de unemployment data werd gekozen voor 24 klassen (K = 24). Op het eerste zicht schijnen de residu’s een verloop te vertonen dat min of meer overeenkomt met dat van de Gauss-verdeling. Op deze vaststelling mag men echter niet volledig vertrouwen. Daarom dient men bijkomende zekerheid te verkrijgen door een beroep te doen op het rootogram, dat betrekking heeft op de werkelijke frequenties en de frequenties die worden verwacht.

Uit onderstaand rootogram kan men afleiden dat de residu’s normaal verdeeld zijn. Immers, van de 36 klassencoëfficiënten zijn er slechts twee significant verschillend van nul (in absolute waarde groter dan twee). Dit is mogelijk door de aanwezigheid van outliers, maar de bijkomende bevestiging door de Chi-kwadraat test (α = 5%)

doet ons besluiten dat deze extreme waarden geen doorslaggevende invloed hebben.

Suspended rootogram of AG_unempl_lo.ds.res by bind = 0 D = 0 L = 1Chi-square test at 5%:THIS SERIES IS NORMALLY DISTRIBUTED

Hierboven is de Lorenz Curve afgebeeld. De daarmee gepaard gaande Gini-coëfficiënt is gelijk aan 0.5. Deze mag niet te dicht bij 0 of 1 mag liggen, dus een waarde van 0.5 is zeer aannemelijk. Ik beschik echter niet over een ‘geoefend oog’ om aan de hand van de vorm van de Lorenz-curve een scheefheid te herkennen, maar dit wordt ook niet van ons verwacht.

Bij onderstaande Relative Contribution dient men de gele lijn, die van de residu’s van de unemployment data, te vergelijken met de witte lijn. Deze laatste geeft aan hoe de Relative Contribution in ideale omstandigheden zou moeten verlopen, namelijk volgens de normaalverdeling. Hieruit blijkt dat onze residu’s een iets spitser verloop kennen ten opzichte van deze normaalverdeling. Het vastgestelde resultaat is desalniettemin bevredigend. Toch dient opgemerkt te worden dat deze methode minder betrouwbaar is dan het voorheen besproken rootogram.

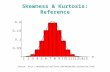

De Skewness vertelt iets over de ‘scheefheid’ van de verdeling, in dit geval de verdeling van de storingstermen. Bij een positieve, dan wel van een negatieve skweness is er respectievelijk sprake van een rechtsscheve, dan wel een linksscheve verdeling ten opzichte van de normaalverdeling, welke een skewness heeft van nul.

De Kurtosis daarentegen gaat na of de staarten van de verdeling van de residu’s dikker of dunner zijn dan deze van de normaalverdeling. Ook hier is voor de normaalverdeling de Kurtosis gelijk aan nul.

Om hieromtrent een zinnig besluit te trekken, dient men zich te baseren op de Fisher Test 1 & 2 en hun bijhorende waarschijnlijkheden. Aan de hand van de waarde dient men de nulhypothese al dan niet te verwerpen. De nulhypothese voor de Fisher 1 Test luidt als volgt: de residu’s van de unemployment data komen qua skewness overeen met de normaalverdeling. Het is een algemeen gegeven dat “the smaller the p-value, the more statistical evidence exist to support the alternative hypothesis”. Omdat bij de Fisher 1 test de p-waarde (0.0278) gelegen is tussen 1% en 5%, is er sprake van een ‘strong evidence to infer that the alternative hypothesis is true’ of met andere woorden: de skewness komt niet overeen met die van de normaalverdeling. De interpretatie met betrekking tot de Fisher 2 test is analoog. Aangezien de p-waarde (0.0602) gelegen is tussen de vijf en tien procent, kan men dus stellen dat kurtosis van de residu’s overeenkomt met die van de normaalverdeling. Om echter absolute zekerheid te hebben moet de p-waarde groter zijn dan 10%, immers in dat geval is er ‘no evidence to infer that the alternative hypothesis is true’.

Skewness and Kurtosis - Ungrouped DataSkewness Measure Value Kurtosis Measure ValueFISHER 3rd Cent. Mom. 0.041742 FISHER 4th Cent. Mom. 0.270934FISHER beta 1 0.080350 FISHER beta 2 3.484071FISHER gamma 1 0.283460 FISHER gamma 2 0.484071FISHER gamma 1 (S.E.) 0.129279 FISHER gamma 2 (S.E.) 0.258558FISHER Test 1 2.192622 FISHER Test 2 1.872192FISHER Test 1 Probability 0.027800 FISHER Test 2 Probability 0.060200Pearson 2 0.186981Yule using Quartile definition:Weighted Average at Xnp 0.043303

Yule using Quartile definition:Weighted Average at X(n+1)p 0.047806

Yule using Quartile definition:Empirical Distribution Function 0.047806

Yule using Quartile definition:Empirical Distribution Function - Averaging 0.047806

Yule using Quartile definition:Empirical Distribution Function - Interpolation 0.049109

Yule using Quartile definition:Closest Observation 0.044858

Yule using Quartile definition:True Basic - Statistics Graphics Toolkit 0.047806

Yule using Quartile definition:MS Excel (old versions) 0.047806

Skewness Measure (small sample) Value Kurtosis Measure (small sample) ValueSkewness (small sample) 0.284651 Kurtosis (small sample) 0.507782Skewness S.E. (small sample) 0.128743 Kurtosis S.E. (small sample) 0.256786TEST 1 (small sample) 2.210996 TEST 1 (small sample) 1.977450TEST 1 Prob. (small sample) 0.026400 TEST 1 Prob. (small sample) 0.047800Observations 359

Het verwijderen van de meest extreme waarden (outliers) zal een invloed hebben de skewness en kurtosis van de residu’s en bijgevolg ook op de p-waarde. Hiertoe wordt gebruik gemaakt van de Trimmed Skewness en Trimmed Kurtosis, weergegeven in onderstaande tabel. Zoals boven geconcludeerd, dient de p-waarde zo groot mogelijk te zijn, of in ieder geval toch groter dan 10%. Uit de tabel kan je aflezen dat de p-waarde van de trimmed skweness toeneemt naarmate meer extreme waarden buiten beschouwing worden gelaten. Bij de trimmed kurtosis zien we allereerst een toename van de p-waarde, waarna deze vervolgens weer afneemt. Er mogen bijgevolg niet al te veel outliers weggelaten worden. Indien echter de drie meest extreme residu’s buiten beschouwing worden gelaten, levert dit de beste resultaten op aangaande skewness en kurtosis.

Trimmed Skewness and Kurtosis (small sample) - Ungrouped DataSkewness Measure (small sample) Value Probabilit

yKurtosis Measure (small

sample) Value Probability

Trimmed Skewness (0/359) 0.284700 0.026400 Trimmed Kurtosis (0/359) 0.507800 0.047800Trimmed Skewness (1/359) 0.274400 0.033200 Trimmed Kurtosis (1/359) 0.256200 0.317400Trimmed Skewness (2/359) 0.239100 0.064400 Trimmed Kurtosis (2/359) 0.015400 0.952200Trimmed Skewness (3/359) 0.204600 0.114200 Trimmed Kurtosis (3/359) -0.122300 0.631200Trimmed Skewness (4/359) 0.187600 0.147000 Trimmed Kurtosis (4/359) -0.196000 0.447200Trimmed Skewness (5/359) 0.176800 0.173800 Trimmed Kurtosis (5/359) -0.241900 0.352400Trimmed Skewness (6/359) 0.166000 0.204000 Trimmed Kurtosis (6/359) -0.283600 0.275800Trimmed Skewness (7/359) 0.155000 0.234000 Trimmed Kurtosis (7/359) -0.328700 0.207600Trimmed Skewness (8/359) 0.142400 0.275800 Trimmed Kurtosis (8/359) -0.377000 0.149800Trimmed Skewness (9/359) 0.132800 0.312400 Trimmed Kurtosis (9/359) -0.420500 0.109600Trimmed Skewness (10/359) 0.124400 0.347200 Trimmed Kurtosis (10/359) -0.462300 0.078400Trimmed Skewness (11/359) 0.115900 0.378800 Trimmed Kurtosis (11/359) -0.510700 0.053600Trimmed Skewness (12/359) 0.115500 0.384400 Trimmed Kurtosis (12/359) -0.537000 0.042400Trimmed Skewness (13/359) 0.118700 0.373400 Trimmed Kurtosis (13/359) -0.557000 0.035800Trimmed Skewness (14/359) 0.121600 0.362800 Trimmed Kurtosis (14/359) -0.579300 0.030000Trimmed Skewness (15/359) 0.122800 0.357600 Trimmed Kurtosis (15/359) -0.601600 0.024400Trimmed Skewness (16/359) 0.123000 0.357600 Trimmed Kurtosis (16/359) -0.624700 0.019800Trimmed Skewness (17/359) 0.123700 0.357600 Trimmed Kurtosis (17/359) -0.643100 0.016800Trimmed Skewness (18/359) 0.126000 0.352400 Trimmed Kurtosis (18/359) -0.661800 0.014200Trimmed Skewness (19/359) 0.129200 0.342200 Trimmed Kurtosis (19/359) -0.683300 0.011800Trimmed Skewness (20/359) 0.131600 0.332000 Trimmed Kurtosis (20/359) -0.700800 0.009800Trimmed Skewness (21/359) 0.134000 0.327000 Trimmed Kurtosis (21/359) -0.720800 0.008000Trimmed Skewness (22/359) 0.134300 0.327000 Trimmed Kurtosis (22/359) -0.741200 0.006800Trimmed Skewness (23/359) 0.133500 0.332000 Trimmed Kurtosis (23/359) -0.759800 0.005600Trimmed Skewness (24/359) 0.134200 0.327000 Trimmed Kurtosis (24/359) -0.775800 0.004800Trimmed Skewness (25/359) 0.133100 0.332000 Trimmed Kurtosis (25/359) -0.790800 0.004200Trimmed Skewness (26/359) 0.132900 0.337000 Trimmed Kurtosis (26/359) -0.800700 0.003800Trimmed Skewness (27/359) 0.132500 0.342200 Trimmed Kurtosis (27/359) -0.813300 0.003400Trimmed Skewness (28/359) 0.129800 0.352400 Trimmed Kurtosis (28/359) -0.825900 0.003000Trimmed Skewness (29/359) 0.127600 0.362800 Trimmed Kurtosis (29/359) -0.840200 0.002600Trimmed Skewness (30/359) 0.125100 0.373400 Trimmed Kurtosis (30/359) -0.857900 0.002200

Trimmed Skewness (31/359) 0.124000 0.378800 Trimmed Kurtosis (31/359) -0.873800 0.002000Trimmed Skewness (32/359) 0.123700 0.378800 Trimmed Kurtosis (32/359) -0.890300 0.001600Trimmed Skewness (33/359) 0.124800 0.378800 Trimmed Kurtosis (33/359) -0.902500 0.001400Trimmed Skewness (34/359) 0.130600 0.357600 Trimmed Kurtosis (34/359) -0.908200 0.001400Trimmed Skewness (35/359) 0.136800 0.337000 Trimmed Kurtosis (35/359) -0.914600 0.001400Trimmed Skewness (36/359) 0.142600 0.317400 Trimmed Kurtosis (36/359) -0.921600 0.001200Trimmed Skewness (37/359) 0.145000 0.312400 Trimmed Kurtosis (37/359) -0.924500 0.001200Trimmed Skewness (38/359) 0.148600 0.303000 Trimmed Kurtosis (38/359) -0.926700 0.001200Trimmed Skewness (39/359) 0.152200 0.293800 Trimmed Kurtosis (39/359) -0.929900 0.001400Trimmed Skewness (40/359) 0.155000 0.284600 Trimmed Kurtosis (40/359) -0.933400 0.001200

Bovenstaande bevindingen kan men ook afleiden uit de volgende twee grafieken. Het voornaamste is dat de upper en lower limit respectievelijk boven en onder de X-as gelegen zijn. Wanneer nog alle residu’s in beschouwing worden genomen, blijkt dat zowel bij de trimmed skweness als bij de trimmed kurtosis hieraan niet voldaan is. Het weglaten van enkele outliers heeft wel degelijk een positieve invloed.

Step 3: Compute various measures of central tendency for the residuals. Is the mean significantly different from zero? How robust is this hypothesis? What happens if the residual mean is significantly different from zero?Om te voldoen aan de voorwaarden dienen de verscheidene t-statistieken niet significant verschillend van nul te zijn. De t-statistiek van het Arithmetic Mean is significant verschillend van nul, maar ligt in absolute waarde toch dicht bij twee. Wat de Winsorized Mean betreft, kunnen we ook stellen dat deze steeds rond de absolute waarde 2 schommelt, maar indien de staarten van het histogram gelijk worden gemaakt door x aantal extreme waarden gelijk te stellen aan minder extreme waarden, merken we dat de t-statistiek niet significant wordt. De Trimmed Mean is ook slechts niet significant verschillend van nul wanneer een aantal ouliers worden weggelaten. Voor de unemployment data is er sprake van ‘niet-significantie’ wanneer er 2 of meer residu’s buiten beschouwing worden gelaten. Wanneer echter veel residu’s (9 of meer) worden weggelaten, merken we dat de t-statistiek terug toeneemt, maar dat deze wel significant blijft indien er minder dan 30 worden weggelaten. Over het Geometric Mean, Harmonic Mean, Quadratic Mean, Median, Midrange en Midmean kan ik echter niks zinnig vertellen, daar ik niet beschik over de bijhorende t-statistieken.

Central Tendency - Ungrouped DataMeasure Value S.E. Value/S.E.

Arithmetic Mean 0.006731 0.027910 0.241185Standard Error 0.528810

Geometric Mean NANHarmonic Mean -0.559484

Quadratic Mean 0.528116Winzorized Mean (0/359) 0.006731 0.027910 0.241185Winzorized Mean (1/359) 0.007184 0.027830 0.258145Winzorized Mean (2/359) 0.007358 0.027582 0.266758Winzorized Mean (3/359) 0.006129 0.027304 0.224480Winzorized Mean (4/359) 0.005450 0.027040 0.201563Winzorized Mean (5/359) 0.005361 0.026894 0.199354Winzorized Mean (6/359) 0.005205 0.026826 0.194031Winzorized Mean (7/359) 0.005350 0.026739 0.200080Winzorized Mean (8/359) 0.004477 0.026595 0.168347Winzorized Mean (9/359) 0.003995 0.026450 0.151056Winzorized Mean (10/359) 0.003754 0.026401 0.142204Winzorized Mean (11/359) 0.001130 0.025974 0.043518Winzorized Mean (12/359) -0.000275 0.025718 -0.010679Winzorized Mean (13/359) -0.000054 0.025636 -0.002121Winzorized Mean (14/359) 0.000691 0.025506 0.027080Winzorized Mean (15/359) 0.001137 0.025391 0.044798Winzorized Mean (16/359) 0.000832 0.025145 0.033090Winzorized Mean (17/359) 0.000009 0.025027 0.000346Winzorized Mean (18/359) -0.000456 0.024964 -0.018263Winzorized Mean (19/359) 0.000047 0.024706 0.001905Winzorized Mean (20/359) 0.000067 0.024640 0.002739Winzorized Mean (21/359) 0.001371 0.024489 0.055975Winzorized Mean (22/359) 0.002105 0.024272 0.086731Winzorized Mean (23/359) 0.001009 0.024054 0.041945Winzorized Mean (24/359) 0.002210 0.023851 0.092661Winzorized Mean (25/359) 0.001525 0.023530 0.064802Winzorized Mean (26/359) 0.001612 0.023501 0.068577Winzorized Mean (27/359) 0.003350 0.023335 0.143546Winzorized Mean (28/359) 0.002718 0.023273 0.116793Winzorized Mean (29/359) 0.002730 0.023255 0.117377Winzorized Mean (30/359) 0.001363 0.023047 0.059122Winzorized Mean (31/359) 0.000473 0.022920 0.020643Winzorized Mean (32/359) -0.000849 0.022584 -0.037578Winzorized Mean (33/359) -0.005702 0.022140 -0.257529Winzorized Mean (34/359) -0.005943 0.022039 -0.269656Winzorized Mean (35/359) -0.005030 0.021955 -0.229089Winzorized Mean (36/359) -0.001331 0.021597 -0.061650Winzorized Mean (37/359) -0.002565 0.021457 -0.119558Winzorized Mean (38/359) -0.002498 0.021399 -0.116734Winzorized Mean (39/359) -0.001401 0.021305 -0.065780Winzorized Mean (40/359) -0.000098 0.021140 -0.004659Trimmed Mean (0/359) 0.006731 0.027910 0.241185

Trimmed Mean (1/359) 0.006109 0.027256 0.224140Trimmed Mean (2/359) 0.005022 0.026671 0.188296Trimmed Mean (3/359) 0.003834 0.026231 0.146172Trimmed Mean (4/359) 0.003052 0.025874 0.117952Trimmed Mean (5/359) 0.002435 0.025565 0.095247Trimmed Mean (6/359) 0.001830 0.025272 0.072392Trimmed Mean (7/359) 0.001244 0.024980 0.049803Trimmed Mean (8/359) 0.000630 0.024690 0.025523Trimmed Mean (9/359) 0.000124 0.024413 0.005075Trimmed Mean (10/359) -0.000332 0.024145 -0.013736Trimmed Mean (11/359) -0.000767 0.023871 -0.032128Trimmed Mean (12/359) -0.000952 0.023639 -0.040261Trimmed Mean (13/359) -0.001013 0.023424 -0.043228Trimmed Mean (14/359) -0.001093 0.023207 -0.047076Trimmed Mean (15/359) -0.001232 0.022995 -0.053555Trimmed Mean (16/359) -0.001405 0.022785 -0.061659Trimmed Mean (17/359) -0.001559 0.022588 -0.069034Trimmed Mean (18/359) -0.001662 0.022393 -0.074213Trimmed Mean (19/359) -0.001737 0.022195 -0.078250Trimmed Mean (20/359) -0.001842 0.022009 -0.083713Trimmed Mean (21/359) -0.001951 0.021820 -0.089394Trimmed Mean (22/359) -0.002131 0.021634 -0.098493Trimmed Mean (23/359) -0.002352 0.021456 -0.109603Trimmed Mean (24/359) -0.002520 0.021286 -0.118406Trimmed Mean (25/359) -0.002749 0.021121 -0.130172Trimmed Mean (26/359) -0.002949 0.020969 -0.140644Trimmed Mean (27/359) -0.003156 0.020814 -0.151619Trimmed Mean (28/359) -0.003441 0.020661 -0.166555Trimmed Mean (29/359) -0.003704 0.020506 -0.180609Trimmed Mean (30/359) -0.003970 0.020345 -0.195124Trimmed Mean (31/359) -0.004185 0.020190 -0.207264Trimmed Mean (32/359) -0.004368 0.020036 -0.217991Trimmed Mean (33/359) -0.004502 0.019893 -0.226329Trimmed Mean (34/359) -0.004458 0.019768 -0.225496Trimmed Mean (35/359) -0.004403 0.019642 -0.224180Trimmed Mean (36/359) -0.004381 0.019514 -0.224494Trimmed Mean (37/359) -0.004488 0.019399 -0.231324Trimmed Mean (38/359) -0.004553 0.019286 -0.236096Trimmed Mean (39/359) -0.004623 0.019171 -0.241120Trimmed Mean (40/359) -0.004729 0.019055 -0.248163Median -0.026228Midrange 0.117791Midmean -0.017268

Observations 359

De bovenstaande bevindingen worden gestaafd door de twee grafieken die hier geïllustreerd worden. De upper en lower limit zijn respectievelijk boven en onder de X-as gelegen en zowel het Winsorized Mean als Trimmed Mean schommelen rond de 0. Zoals hierboven reeds werd beschreven is het best een aantal observaties buiten beschouwing te laten. Echter, een teveel aan residu’s weglaten heeft een negatief effect op de gemiddeldes. Dit blijkt vooral uit de grafiek van het trimmed mean, die verder verwijdert ligt van nul bij het weglaten van een te groot aantal residu’s.

Step 4: How could we describe (compute) the 50% confidence interval (of a 1-step-ahead forecast) based on variability, quartiles, and percentiles? What computation would you use to derive the 83% confidence interval?Wat betreft de variability kan men kijken naar het verschil tussen de variabiliteitsmaatstaven ten aanzien van het gemiddelde en dezelfde maatstaven ten aanzien van de mediaan. Indien beide sterk van elkaar verschillen, zal je niet te maken hebben met een normaalverdeling. Omdat de Mean Absolute Deviation (MAD), Median Absolute Deviation en Mean Squared Deviation van de mediaan en het gemiddelde nagenoeg aan elkaar gelijk zijn, kan men dus stellen dat er sprake is van een normaalverdeling. Ook het verschil tussen de grootste en de kleinste meetuitslag mag niet al te groot zijn. Hier is de range ongeveer gelijk aan 3.37 wat

bevredigend is. Daarnaast kan men zich ook nog baseren op de variantie en de standard error, die niet te groot mogen zijn. Ook dit is hier het geval.

Variability - Ungrouped DataVariability Measure ValueAbsolute Range 3.367684Relative Range (unbiased) 6.368415Relative Range (biased) 6.377304Variance (unbiased) 0.279640Trimmed, Unbiased Variance (0/359) 0.279640Trimmed, Unbiased Variance (1/359) 0.265213Trimmed, Unbiased Variance (2/359) 0.252523Trimmed, Unbiased Variance (3/359) 0.242893Trimmed, Unbiased Variance (4/359) 0.234987Trimmed, Unbiased Variance (5/359) 0.228121Trimmed, Unbiased Variance (6/359) 0.221651Trimmed, Unbiased Variance (7/359) 0.215308Trimmed, Unbiased Variance (8/359) 0.209137Trimmed, Unbiased Variance (9/359) 0.203284Trimmed, Unbiased Variance (10/359) 0.197675Trimmed, Unbiased Variance (11/359) 0.192082Trimmed, Unbiased Variance (12/359) 0.187259Trimmed, Unbiased Variance (13/359) 0.182772Trimmed, Unbiased Variance (14/359) 0.178334Trimmed, Unbiased Variance (15/359) 0.174029Trimmed, Unbiased Variance (16/359) 0.169826Trimmed, Unbiased Variance (17/359) 0.165888Trimmed, Unbiased Variance (18/359) 0.162035Trimmed, Unbiased Variance (19/359) 0.158201Trimmed, Unbiased Variance (20/359) 0.154594Trimmed, Unbiased Variance (21/359) 0.151004Trimmed, Unbiased Variance (22/359) 0.147512Trimmed, Unbiased Variance (23/359) 0.144177Trimmed, Unbiased Variance (24/359) 0.140992Trimmed, Unbiased Variance (25/359) 0.137930Trimmed, Unbiased Variance (26/359) 0.135088Trimmed, Unbiased Variance (27/359) 0.132225Trimmed, Unbiased Variance (28/359) 0.129447Trimmed, Unbiased Variance (29/359) 0.126678Trimmed, Unbiased Variance (30/359) 0.123883Trimmed, Unbiased Variance (31/359) 0.121192Trimmed, Unbiased Variance (32/359) 0.118546

Trimmed, Unbiased Variance (33/359) 0.116075Trimmed, Unbiased Variance (34/359) 0.113836Trimmed, Unbiased Variance (35/359) 0.111618Trimmed, Unbiased Variance (36/359) 0.109416Trimmed, Unbiased Variance (37/359) 0.107382Trimmed, Unbiased Variance (38/359) 0.105394Trimmed, Unbiased Variance (39/359) 0.103407Trimmed, Unbiased Variance (40/359) 0.101438Variance (biased) 0.278861Standard Error (unbiased) 0.528810Standard Error (biased) 0.528073Coefficient of Variation (unbiased) 78.559144Coefficient of Variation (biased) 78.449654Mean Squared Error (MSE versus 0) 0.278907Mean Squared Error (MSE versus Mean) 0.278861Mean Absolute Deviation from Mean (MAD Mean) 0.411215Mean Absolute Deviation from Median (MAD Median) 0.410023Median Absolute Deviation from Mean 0.328290Median Absolute Deviation from Median 0.323866Mean Squared Deviation from Mean 0.278861Mean Squared Deviation from Median 0.279948Interquartile Difference (Weighted Average at Xnp) 0.652869Interquartile Difference (Weighted Average at X(n+1)p) 0.652948Interquartile Difference (Empirical Distribution Function) 0.652948Interquartile Difference (Empirical Distribution Function - Averaging) 0.652948Interquartile Difference (Empirical Distribution Function - Interpolation) 0.650216Interquartile Difference (Closest Observation) 0.650933Interquartile Difference (True Basic - Statistics Graphics Toolkit) 0.652948Interquartile Difference (MS Excel (old versions)) 0.652948Semi Interquartile Range (Weighted Average at Xnp) 0.326435Semi Interquartile Range (Weighted Average at X(n+1)p) 0.326474Semi Interquartile Range (Empirical Distribution Function) 0.326474Semi Interquartile Range (Empirical Distribution Function - Averaging) 0.326474Semi Interquartile Range (Empirical Distribution Function - Interpolation) 0.325108Semi Interquartile Range (Closest Observation) 0.325466Semi Interquartile Range (True Basic - Statistics Graphics Toolkit) 0.326474Semi Interquartile Range (MS Excel (old versions)) 0.326474Coefficent of Quartile Variation (Weighted Average at Xnp) -26.995416Coefficent of Quartile Variation (Weighted Average at X(n+1)p) -30.740811Coefficent of Quartile Variation (Empirical Distribution Function) -30.740811Coefficent of Quartile Variation (Empirical Distribution Function - Averaging) -30.740811Coefficent of Quartile Variation (Empirical Distribution Function - Interpolation) -31.680796Coefficent of Quartile Variation (Closest Observation) -27.990297

Coefficent of Quartile Variation (True Basic - Statistics Graphics Toolkit) -30.740811Coefficent of Quartile Variation (MS Excel (old versions)) -30.740811Number of all Pairs of Observations 64261.000000Squared Differences between all Pairs of Observations 0.559281Mean Absolute Differences between all Pairs of Observations 0.589980Gini's Mean Difference 0.589980Leik's Measure of Dispersion -42.823227Index of Diversity -16.145817Index of Qualitative Variation -16.190917Coefficient of Dispersion 15.633191Observations 359

Quartiles - Ungrouped DataMethod Quartile 1 Quartile 2 Quartile 3Weighted Average at Xnp -0.338527 -0.026767 0.314342Weighted Average at X(n+1)p -0.337094 -0.026228 0.315854Empirical Distribution Function -0.337094 -0.026228 0.315854Empirical Distribution Function - Averaging -0.337094 -0.026228 0.315854Empirical Distribution Function - Interpolation -0.335370 -0.026228 0.314846Closest Observation -0.337094 -0.026228 0.313839True Basic - Statistics Graphics Toolkit -0.337094 -0.026228 0.315854MS Excel (old versions) -0.337094 -0.026228 0.315854Observations 359

Wil het verloop van de residu’s niet afwijken van dit van de normaalverdeling, moet de absolute waarde van het eerste en derde kwartiel min of meer aan elkaar gelijk zijn. Daarenboven moet het tweede kwartiel ongeveer gelijk zijn aan nul. Uit de bovenstaande tabel blijkt dat deze voorwaarde voldaan is en kunnen we zeggen dat de residu’s (min of meer) normaal verdeeld zijn.

De onder- en bovengrens van het 50% betrouwbaarheidsinterval zijn respectievelijk gelijk aan kwartiel één (Q1) en kwartiel drie (Q3). Immers, Q1 bevat 25% en Q3 75% van de waarnemingsgetallen, met als gevolg dat het interval [Q1; Q3] of in dit geval het interval [-0.338527; 0.314342] vijftig procent van de waarnemingsgetallen bevat. De breedte van het 50% betrouwbaarheidsinterval is bijgevolg gelijk aan 0.652869 (0.338527 + 0.314342). Dit getal kan ook afgelezen worden uit Variability-tabel. Het 83% betrouwbaarheidsinterval kan men aan de hand van de kwartielen echter niet berekenen.

Percentiles - Ungrouped Data

%Weighted Average at Xnp

Weighted Average

at X(n+1)p

Empirical Distribution

Function

Empirical Distribution Function - Averaging

Empirical Distribution Function -

Interpolation

Closest Observation

True Basic - Statistics Graphics Toolkit

MS Excel (old

versions)

0.01 -1.1428 -1.1424 -1.1271 -1.1271 -1.1001 -1.1271 -1.1500 -1.1271

0.02 -1.0348 -1.0344 -1.0162 -1.0162 -1.0148 -1.0389 -1.0207 -1.03890.03 -0.9918 -0.9917 -0.9913 -0.9913 -0.9743 -0.9913 -0.9929 -0.99130.04 -0.9351 -0.9340 -0.9185 -0.9185 -0.9124 -0.9444 -0.9288 -0.94440.05 -0.8718 -0.8717 -0.8717 -0.8717 -0.8704 -0.8717 -0.8717 -0.87170.06 -0.8209 -0.8194 -0.8095 -0.8095 -0.7974 -0.8095 -0.8244 -0.80950.07 -0.7467 -0.7452 -0.7286 -0.7286 -0.7284 -0.7494 -0.7327 -0.74940.08 -0.7016 -0.7016 -0.7015 -0.7015 -0.7007 -0.7015 -0.7018 -0.70150.09 -0.6869 -0.6856 -0.6769 -0.6769 -0.6764 -0.6914 -0.6827 -0.69140.10 -0.6615 -0.6605 -0.6605 -0.6605 -0.6283 -0.6605 -0.6605 -0.66050.11 -0.6091 -0.6080 -0.6038 -0.6038 -0.5980 -0.6143 -0.6101 -0.60380.12 -0.5667 -0.5657 -0.5587 -0.5587 -0.5590 -0.5674 -0.5604 -0.56740.13 -0.5439 -0.5432 -0.5422 -0.5422 -0.5369 -0.5422 -0.5462 -0.54220.14 -0.5158 -0.5147 -0.5100 -0.5100 -0.5099 -0.5179 -0.5131 -0.51790.15 -0.5072 -0.5071 -0.5071 -0.5071 -0.5005 -0.5071 -0.5071 -0.50710.16 -0.4911 -0.4910 -0.4908 -0.4908 -0.4868 -0.4914 -0.4912 -0.49080.17 -0.4581 -0.4562 -0.4472 -0.4472 -0.4488 -0.4584 -0.4495 -0.45840.18 -0.4348 -0.4342 -0.4336 -0.4336 -0.4313 -0.4336 -0.4360 -0.43360.19 -0.4192 -0.4167 -0.4090 -0.4090 -0.4090 -0.4219 -0.4142 -0.42190.20 -0.4041 -0.4039 -0.4039 -0.4039 -0.4033 -0.4039 -0.4039 -0.40390.21 -0.3957 -0.3953 -0.3946 -0.3946 -0.3943 -0.3964 -0.3957 -0.39460.22 -0.3912 -0.3893 -0.3911 -0.3911 -0.3840 -0.3911 -0.3836 -0.39110.23 -0.3731 -0.3728 -0.3727 -0.3727 -0.3726 -0.3727 -0.3734 -0.37270.24 -0.3567 -0.3566 -0.3562 -0.3562 -0.3563 -0.3568 -0.3565 -0.35680.25 -0.3385 -0.3371 -0.3371 -0.3371 -0.3354 -0.3371 -0.3371 -0.33710.26 -0.3234 -0.3227 -0.3216 -0.3216 -0.3215 -0.3244 -0.3233 -0.32160.27 -0.3108 -0.3097 -0.3101 -0.3101 -0.3086 -0.3101 -0.3083 -0.31010.28 -0.2996 -0.2969 -0.2950 -0.2950 -0.2942 -0.2950 -0.3026 -0.29500.29 -0.2763 -0.2758 -0.2750 -0.2750 -0.2753 -0.2764 -0.2756 -0.27640.30 -0.2657 -0.2653 -0.2653 -0.2653 -0.2650 -0.2653 -0.2653 -0.26530.31 -0.2578 -0.2573 -0.2567 -0.2567 -0.2567 -0.2582 -0.2576 -0.25670.32 -0.2516 -0.2511 -0.2511 -0.2511 -0.2509 -0.2511 -0.2508 -0.25110.33 -0.2472 -0.2462 -0.2457 -0.2457 -0.2452 -0.2484 -0.2479 -0.24570.34 -0.2336 -0.2326 -0.2310 -0.2310 -0.2317 -0.2337 -0.2321 -0.23370.35 -0.2114 -0.2113 -0.2113 -0.2113 -0.2105 -0.2113 -0.2114 -0.21130.36 -0.1966 -0.1946 -0.1924 -0.1924 -0.1930 -0.1979 -0.1957 -0.19240.37 -0.1813 -0.1799 -0.1809 -0.1809 -0.1785 -0.1809 -0.1768 -0.18090.38 -0.1679 -0.1659 -0.1648 -0.1648 -0.1647 -0.1702 -0.1691 -0.16480.39 -0.1414 -0.1410 -0.1405 -0.1405 -0.1408 -0.1414 -0.1409 -0.14140.40 -0.1353 -0.1342 -0.1342 -0.1342 -0.1325 -0.1342 -0.1342 -0.13420.41 -0.1224 -0.1222 -0.1220 -0.1220 -0.1221 -0.1224 -0.1223 -0.12200.42 -0.1059 -0.1057 -0.1059 -0.1059 -0.1056 -0.1059 -0.1053 -0.10590.43 -0.0929 -0.0923 -0.0921 -0.0921 -0.0922 -0.0934 -0.0931 -0.09210.44 -0.0778 -0.0774 -0.0775 -0.0775 -0.0774 -0.0775 -0.0773 -0.0775

0.45 -0.0717 -0.0709 -0.0709 -0.0709 -0.0708 -0.0709 -0.0709 -0.07090.46 -0.0637 -0.0617 -0.0600 -0.0600 -0.0613 -0.0643 -0.0626 -0.06000.47 -0.0547 -0.0527 -0.0531 -0.0531 -0.0525 -0.0531 -0.0514 -0.05310.48 -0.0498 -0.0495 -0.0493 -0.0493 -0.0494 -0.0500 -0.0499 -0.04930.49 -0.0420 -0.0409 -0.0420 -0.0420 -0.0408 -0.0420 -0.0403 -0.04200.50 -0.0268 -0.0262 -0.0262 -0.0262 -0.0262 -0.0262 -0.0262 -0.02620.51 -0.0162 -0.0155 -0.0150 -0.0150 -0.0156 -0.0163 -0.0158 -0.01500.52 -0.0089 -0.0088 -0.0088 -0.0088 -0.0088 -0.0088 -0.0086 -0.00880.53 -0.0040 0.0029 0.0055 0.0055 0.0021 -0.0074 -0.0049 0.00550.54 0.0174 0.0181 0.0175 0.0175 0.0180 0.0175 0.0184 0.01750.55 0.0288 0.0297 0.0297 0.0297 0.0295 0.0281 0.0335 0.02970.56 0.0442 0.0492 0.0528 0.0528 0.0481 0.0438 0.0474 0.05280.57 0.0660 0.0701 0.0689 0.0689 0.0693 0.0689 0.0734 0.06890.58 0.0813 0.0825 0.0829 0.0829 0.0822 0.0808 0.0812 0.08290.59 0.0880 0.0892 0.0888 0.0888 0.0890 0.0888 0.0894 0.08880.60 0.0961 0.1026 0.1026 0.1026 0.1004 0.0918 0.1026 0.10260.61 0.1089 0.1101 0.1090 0.1090 0.1097 0.1090 0.1097 0.11080.62 0.1313 0.1342 0.1338 0.1338 0.1335 0.1338 0.1354 0.13380.63 0.1443 0.1511 0.1532 0.1532 0.1483 0.1425 0.1446 0.15320.64 0.1672 0.1697 0.1689 0.1689 0.1691 0.1689 0.1701 0.16890.65 0.1857 0.1861 0.1861 0.1861 0.1859 0.1855 0.1861 0.18610.66 0.1968 0.1972 0.1969 0.1969 0.1970 0.1969 0.1971 0.19740.67 0.2078 0.2114 0.2108 0.2108 0.2099 0.2108 0.2133 0.21080.68 0.2170 0.2179 0.2181 0.2181 0.2174 0.2169 0.2171 0.21810.69 0.2357 0.2402 0.2396 0.2396 0.2396 0.2396 0.2405 0.23960.70 0.2555 0.2604 0.2604 0.2604 0.2576 0.2534 0.2534 0.26040.71 0.2661 0.2669 0.2666 0.2666 0.2667 0.2666 0.2668 0.26720.72 0.2762 0.2779 0.2765 0.2765 0.2763 0.2759 0.2822 0.27650.73 0.2919 0.2927 0.2929 0.2929 0.2922 0.2918 0.2920 0.29290.74 0.2958 0.2967 0.2961 0.2961 0.2961 0.2961 0.2970 0.29610.75 0.3143 0.3159 0.3159 0.3159 0.3148 0.3138 0.3159 0.31590.76 0.3322 0.3369 0.3335 0.3335 0.3339 0.3335 0.3357 0.33910.77 0.3465 0.3500 0.3472 0.3472 0.3467 0.3459 0.3585 0.34720.78 0.3797 0.3881 0.3903 0.3903 0.3821 0.3795 0.3816 0.39030.79 0.4181 0.4239 0.4232 0.4232 0.4208 0.4232 0.4242 0.42320.80 0.4317 0.4328 0.4328 0.4328 0.4320 0.4314 0.4328 0.43280.81 0.4607 0.4631 0.4612 0.4612 0.4612 0.4612 0.4624 0.46430.82 0.4817 0.4884 0.4864 0.4864 0.4831 0.4788 0.4946 0.48640.83 0.5026 0.5071 0.5027 0.5027 0.5035 0.5027 0.5038 0.50820.84 0.5125 0.5143 0.5140 0.5140 0.5131 0.5140 0.5144 0.51400.85 0.5357 0.5382 0.5382 0.5382 0.5361 0.5352 0.5382 0.53820.86 0.5824 0.5838 0.5837 0.5837 0.5831 0.5837 0.5838 0.58390.87 0.5932 0.5969 0.5966 0.5966 0.5939 0.5916 0.5978 0.5966

0.88 0.6006 0.6078 0.6007 0.6007 0.6011 0.6007 0.6025 0.60960.89 0.6225 0.6244 0.6242 0.6242 0.6229 0.6242 0.6244 0.62420.90 0.6422 0.6453 0.6453 0.6453 0.6425 0.6418 0.6453 0.64530.91 0.6906 0.7252 0.7076 0.7076 0.6955 0.7076 0.7194 0.73690.92 0.7728 0.7753 0.7736 0.7736 0.7729 0.7725 0.7804 0.77360.93 0.7843 0.8090 0.7844 0.7844 0.7844 0.7844 0.7906 0.81510.94 0.8552 0.8634 0.8624 0.8624 0.8560 0.8492 0.8639 0.86240.95 0.8915 0.9016 0.9016 0.9016 0.8920 0.8910 0.9016 0.90160.96 0.9590 0.9661 0.9620 0.9620 0.9594 0.9620 0.9647 0.96880.97 1.0537 1.1395 1.1373 1.1373 1.0569 1.0287 1.1458 1.13730.98 1.2206 1.2415 1.2293 1.2293 1.2216 1.2293 1.2323 1.24450.99 1.3459 1.4835 1.4094 1.4094 1.3470 1.3018 1.5205 1.4094

Wat de bespreking van de percentielen betreft, baseer ik mij op op de “Empirical Distribution Function - Interpolation”. Het p-de percentiel met waarde x dient men te interpreteren als het percentage (p) van de waarnemingsgetallen dat kleiner of gelijk is aan deze waarde. Zo is bijvoorbeeld 25% (p = 0.25) van de waarnemingsgetallen kleiner of gelijk aan - 0.3354.

Om te spreken van een normaalverdeling moet de overgang tussen min en plus ongeveer bij het vijftigste percentiel plaatsvinden. Bij de unemployment data treffen we deze overgang aan bij het 52ste en 53ste percentiel en is aan deze voorwaarde dus voldaan. Ook het gelijk zijn aan nul treft men hier aan. Daarnaast moeten de absolute waarden van een percentiel (%) en zijn complement (1 - %) ook ongeveer met elkaar overeenstemmen. Zo is de absolute waarde van het 25e percentiel (p = 0.25) gelijk aan 0.3354, terwijl het 75e percentiel (p = 0.75) een absolute waarde heeft van 0.3148. Beide absolute waarden stemmen min of meer overeen. Uit dit alles mogen we besluiten dat de residu’s normaal verdeeld zijn.

Ook uit onderstaande QQ Plot kan men dezelfde conclusies trekken. Immers, de percentielen zijn overwegend op de diagonaallijn gelegen. Met andere woorden: de percentielen van de unemployment data komen dus min of meer overeen met deze van de normaalverdeling.

De onder- en bovengrens van het 50% betrouwbaarheidsinterval zijn respectievelijk gelijk aan het 25e en 75e percentiel. Bijgevolg zal het interval [-0.3354; 0.3148] met een breedte van 0.6502 (0.3354 + 0.3148) vijftig procent van de waarnemingsgetallen bevatten.

Voor het bepalen van het 83% betrouwbaarheidsinterval zou men aan de linker- en rechterkant 8.5% moeten nemen. Het is niet mogelijk te werken met percentielen bestaande uit gehele getallen, daarom wordt gekozen voor de gulden middenweg. Allereerst hebben we de onder- en bovengrens respectievelijk bepaald door het 8e en 92e percentiel en krijgt men het interval [-0.7007; 0.7729] met als breedte 1.4736 (0.7007 + 0.0.7729). Daarnaast heeft men als onder- en bovengrens respectievelijk het 9e en 91e percentiel, waarmee men het het interval [-0.6764; 0.6955] met breedte 1.3719 (0.6764 + 0.6955) verkrijgt. Voor mijn gulden middenweg bereken ik gewoon het gemiddelde van de bekomen onder- en bovengrenzen. Ik verkrijg dus het interval [(-0.7007 + -0.6764) / 2; (0.7729 + 0.6955) / 2] of [-0.68855; 0.7342] dat als breedte 1.42275 (0.68855 + 0.7342) heeft.

Step 5: Are the residuals of the time series white noise?Uit de bovenstaande analyse besluit ik dat de residu’s van de unemployment data white noise zijn. Bij de ACF en de daarop gelijkende PACF van de residu’s was er immers niet langer sprake van een specifiek patroon. Daarnaast kon men uit het histogram en rootogram afleiden dat de residu’s min of meer normaal verdeeld zijn. Deze bevindingen werden ook gestaafd aan de hand van de Entropy Concentration output, waaruit men kon afleiden dat het verloop van de residu’s iets spitser is in vergelijking met dat van de normaalverdeling. Wat verder bleek dat er sprake was van enkele outliers, die ook al opgemerkt werden bij de analyse van het rootogram. Uit de bespreking van de skweness en kurtosis bleek dat het opportuun is de drie meest extreme waarden te elimineren. Uitgaande van het trimmed en winsorised mean zouden respectievelijk 2 en 5 outliers verwijderd moeten worden wanneer men zich op de desbetreffende t-statistiek concentreert. Tot slot bood de analyse van de

variability, kwartielen en percentielen bijkomende overtuiging om te zeggen dat de residu’s normaal verdeeld zijn. Bijgevolg is er dus geen enkele reden om aan te nemen dat herschatting van het model nodig zou zijn.

2) Werkloze Werkzoekenden in de periode 07/1997 – 09/2005

Step 1: Compute the ACF, PACF, and Spectrum of the estimated residuals. Is there any indication of a 'forgotten' process? Re-identify the ARIMA model (if necessary) and re-estimate the parameters (and forecast). Important: do not apply any new model estimations/forecasts to the residuals (use the original data instead).

De ACF en PACF kennen min of meer eenzelfde verloop, er is niet langer sprake van een patroon.

Uit het Spectrum en Cumulative Periodogram valt geen lange termijntrend te determineren. De seizoenaliteit is bijgevolg verdwenen, maar toch is er een andere achterliggende oorzaak. Een bijkomende meevaller is dat het Spectrum bijna volledig binnen de grenzen van het betrouwbaarheidsinterval gelegen is.

Step 2: Examine the following diagnostics of the residuals: variability, histogram, rootogram, entropy concentration, skewness & kurtosis, and percentiles. Are the residuals normally distributed? What do you think would happen if they are not normally distributed? Does this influence your analysis? Een eerste manier om na te gaan of de residu’s normaal verdeeld zijn, is gebruik maken van het histogram. Hier werd gekozen om 24 klassen (K = 24) te gebruiken. Men dient wel op te merken dat men op het histogram niet honderd procent mag vertouwen en moet men bijkomende zekerheid verkrijgen aan de hand van het rootogram..

Uit onderstaand rootogram kan men afleiden dat de residu’s normaal verdeeld zijn. Ook de Chi-kwadraat test (α = 5%) ondersteunt de vaststelling dat de storingstermen normaal verdeeld zijn.

Suspended rootogram of AG_wlh_zoek.ds.res by bind = 0 D = 0 L = 1Chi-square test at 5%:THIS SERIES IS NORMALLY DISTRIBUTED

Hierboven is de Lorenz Curve afgebeeld. De daarmee gepaard gaande Gini-coëfficiënt is gelijk aan 0.607558. Deze mag niet te dicht bij 0 of 1 liggen, dus de bekomen waarde is aannemelijk.

Bij onderstaande Relative Contribution dient men de gele lijn te vergelijken met de witte lijn. Men kan er niet direct een volledige Gauss-vormige klokvorm in herkennen. Dit is analoog met wat bij het histogram werd vastgesteld, namelijk de scheefheid van de verdeling van de residu’s. Analoog met de unemployment data is de verdeling ook iets spitser dan deze van de normaalverdeling. , Omdat men zich op het visuele aspect richt, dient men wel op te merken dat deze methode minder betrouwbaar is dan het voorheen besproken rootogram die een meer betrouwbare Chi-kwadraat teststatistiek oplevert.

De Skewness vertelt iets over de ‘scheefheid’ van de verdeling, in dit geval de verdeling van de storingstermen. Bij een positieve, dan wel van een negatieve skweness is er respectievelijk sprake van een rechtsscheve, dan wel een linksscheve verdeling ten opzichte van de normaalverdeling, welke een skewness heeft van nul. De Kurtosis daarentegen gaat na of de staarten van de verdeling van de residu’s dikker of dunner zijn dan deze van de normaalverdeling. Ook hier is voor de normaalverdeling de Kurtosis gelijk aan nul.

Om hieromtrent een zinnig besluit te trekken, dient men zich te baseren op de Fisher Test 1 & 2 en hun bijhorende waarschijnlijkheden. Aan de hand van deze waarschijnlijkheden dient men de nulhypothese al dan niet te verwerpen. De nulhypothese voor de Fisher 1 Test luidt als volgt: het verloop van de residu’s komt qua skewness overeen met het verloop van de normaalverdeling. Het is een algemeen gegeven dat “the smaller the p-value, the more statistical evidence exist to support the alternative hypothesis”. De p-waarde moet dus zo groot mogelijk zijn, bij voorkeur groter dan 0.05 of in het ideale geval zelfs groter dan 10%. Omdat bij de Fisher 1 test de p-waarde (0.582400) groter is dan 1%, is er geen sprake van een ‘overwhelming evidence to infer that the alternative hypothesis is true’. De nulhypothese mag bijgevolg verworpen worden. De interpretatie met betrekking tot de Fisher 2 test is analoog. Aangezien de p-waarde (0.002200) gelegen is tussen de 1% en 5%, dient men hier de nulhypothese te verwerpen.

Skewness and Kurtosis - Ungrouped DataSkewness Measure Value Kurtosis Measure ValueFISHER 3rd Cent. Mom. -3.21293e+10 FISHER 4th Cent. Mom. 6.26426e+15FISHER beta 1 0.020628 FISHER beta 2 4.612869FISHER gamma 1 -0.143624 FISHER gamma 2 1.612869FISHER gamma 1 (S.E.) 0.264135 FISHER gamma 2 (S.E.) 0.528271FISHER Test 1 -0.543752 FISHER Test 2 3.053112FISHER Test 1 Probability 0.582400 FISHER Test 2 Probability 0.002200

Het verwijderen van de meest extreme waarden (outliers) zal een invloed hebben de skewness en kurtosis van de residu’s en bijgevolg ook op de p-waarde. Hiertoe wordt gebruik gemaakt van de Trimmed Skewness en Trimmed Kurtosis, weergegeven in onderstaande tabel. Zoals boven geconcludeerd, dient de p-waarde zo groot mogelijk te zijn. Om een bevredigende p-waarde (> 5%) voor de trimmed skewness te verkrijgen moeten er 6 outliers weggelaten worden, terwijl om een goede trimmed kurtosis te bekomen er 3 extreme waarden weggelaten dienen te worden. Er zullen echter niet al te veel outliers verwijderd mogen worden rekening houdend met het aantal observaties dat in beschouwing wordt genomen.

Trimmed Skewness and Kurtosis (small sample) - Ungrouped Data

Skewness Measure (small sample) Value Probabilit

yKurtosis Measure (small

sample) Value Probability

Trimmed Skewness (0/86) -0.146200 0.568600 Trimmed Kurtosis (0/86) 1.783900 0.000600Trimmed Skewness (1/86) -0.130900 0.617000 Trimmed Kurtosis (1/86) 0.220300 0.667200Trimmed Skewness (2/86) -0.243200 0.357600 Trimmed Kurtosis (2/86) -0.348300 0.502800Trimmed Skewness (3/86) -0.154900 0.562000 Trimmed Kurtosis (3/86) -0.536500 0.312400Trimmed Skewness (4/86) -0.143900 0.596200 Trimmed Kurtosis (4/86) -0.558800 0.298400Trimmed Skewness (5/86) -0.151000 0.582400 Trimmed Kurtosis (5/86) -0.541400 0.317400Trimmed Skewness (6/86) -0.163000 0.555200 Trimmed Kurtosis (6/86) -0.550500 0.317400Trimmed Skewness (7/86) -0.170500 0.541800 Trimmed Kurtosis (7/86) -0.600500 0.280200Trimmed Skewness (8/86) -0.189200 0.509200 Trimmed Kurtosis (8/86) -0.711900 0.207600Trimmed Skewness (9/86) -0.172900 0.548400 Trimmed Kurtosis (9/86) -0.825200 0.149800Trimmed Skewness (10/86) -0.166200 0.568600 Trimmed Kurtosis (10/86) -0.848100 0.144200Trimmed Skewness (11/86) -0.144500 0.624200 Trimmed Kurtosis (11/86) -0.896400 0.128600Trimmed Skewness (12/86) -0.131300 0.660000 Trimmed Kurtosis (12/86) -0.962700 0.107400Trimmed Skewness (13/86) -0.158900 0.603000 Trimmed Kurtosis (13/86) -0.975200 0.107400Trimmed Skewness (14/86) -0.195800 0.528600 Trimmed Kurtosis (14/86) -0.951200 0.123600Trimmed Skewness (15/86) -0.244700 0.441200 Trimmed Kurtosis (15/86) -0.936100 0.136200Trimmed Skewness (16/86) -0.280400 0.384400 Trimmed Kurtosis (16/86) -0.897100 0.158600Trimmed Skewness (17/86) -0.326900 0.322200 Trimmed Kurtosis (17/86) -0.876300 0.177000Trimmed Skewness (18/86) -0.356900 0.284600 Trimmed Kurtosis (18/86) -0.850000 0.197000Trimmed Skewness (19/86) -0.391100 0.254200 Trimmed Kurtosis (19/86) -0.810600 0.226200Trimmed Skewness (20/86) -0.425900 0.222400 Trimmed Kurtosis (20/86) -0.758800 0.267000Trimmed Skewness (21/86) -0.452700 0.204000 Trimmed Kurtosis (21/86) -0.691800 0.322200Trimmed Skewness (22/86) -0.492000 0.177000 Trimmed Kurtosis (22/86) -0.615400 0.389800Trimmed Skewness (23/86) -0.514100 0.167600 Trimmed Kurtosis (23/86) -0.578100 0.429600Trimmed Skewness (24/86) -0.492600 0.197000 Trimmed Kurtosis (24/86) -0.593200 0.423800Trimmed Skewness (25/86) -0.463100 0.238000 Trimmed Kurtosis (25/86) -0.640900 0.400800Trimmed Skewness (26/86) -0.481500 0.230200 Trimmed Kurtosis (26/86) -0.567700 0.465400Trimmed Skewness (27/86) -0.435900 0.289200 Trimmed Kurtosis (27/86) -0.634200 0.429600Trimmed Skewness (28/86) -0.468400 0.271400 Trimmed Kurtosis (28/86) -0.519200 0.528600Trimmed Skewness (29/86) -0.448800 0.307800 Trimmed Kurtosis (29/86) -0.522200 0.541800

De hierboven uiteengezette bevindingen worden gestaafd door de twee grafieken die hier geïllustreerd worden. Indien men een aantal extreme waarden gaat verwijderen, zal zowel de trimmed skweness als de trimmed kurtosis naar nul tenderen. Echter, een teveel aan outliers verwijderen zal een negatief effect hebben op beide statistieken.

Step 3: Compute various measures of central tendency for the residuals. Is the mean significantly different from zero? How robust is this hypothesis? What happens if the residual mean is significantly different from zero?

Om te voldoen aan de voorwaarden dienen de verscheidene t-statistieken niet significant verschillend van nul te zijn. De t-statistiek van het Arithmetic Mean is niet significant verschillend van nul. Wat de Winsorized Mean betreft, kunnen we ook stellen dat de t-statistiek niet significant verschillend is van nul. Echter, de waarde neemt steeds toe, waardoor niet al te veel outliers (indien nodig) buiten beschouwing mogen worden gelaten. Bij de Trimmed Mean stellen we hetzelfde vast, namelijk een toename in waarde van de t-statistiek, waardoor deze significant verschillend van nul wordt wanneer er teveel extreme waarden worden weggelaten. Over het Geometric Mean, Harmonic Mean, Quadratic Mean, Median, Midrange en Midmean kan ik echter niks zinnig vertellen, daar ik niet beschik over de bijhorende t-statistieken.

Central Tendency - Ungrouped DataMeasure Value S.E. Value/S.E.

Arithmetic Mean 329.634309 658.438505 0.500630Standard Error 6106.107497

Geometric Mean NANHarmonic Mean 8531.383818Quadratic Mean 6079.446215Winzorized Mean (0/86) 329.634309 658.438505 0.500630Winzorized Mean (1/86) 355.268437 633.489450 0.560812Winzorized Mean (2/86) 242.860252 592.277771 0.410045Winzorized Mean (3/86) 332.910396 553.221332 0.601767

Winzorized Mean (4/86) 364.423498 540.226556 0.674575Winzorized Mean (5/86) 371.719398 537.513404 0.691554Winzorized Mean (6/86) 360.734461 534.092364 0.675416Winzorized Mean (7/86) 379.100290 528.103238 0.717853Winzorized Mean (8/86) 311.260685 508.136911 0.612553Winzorized Mean (9/86) 339.066093 471.557110 0.719035Winzorized Mean (10/86) 314.311212 462.074620 0.680217Winzorized Mean (11/86) 359.697354 451.615254 0.796469Winzorized Mean (12/86) 485.968729 424.109113 1.145858Winzorized Mean (13/86) 511.645266 401.162575 1.275406Winzorized Mean (14/86) 515.085288 396.046561 1.300568Winzorized Mean (15/86) 440.855297 381.503775 1.155573Winzorized Mean (16/86) 439.574086 379.735008 1.157581Winzorized Mean (17/86) 360.949549 367.847311 0.981248Winzorized Mean (18/86) 361.948826 353.773488 1.023109Winzorized Mean (19/86) 349.691196 340.794491 1.026106Winzorized Mean (20/86) 316.919938 326.695286 0.970078Winzorized Mean (21/86) 346.025445 317.516816 1.089786Winzorized Mean (22/86) 300.117026 311.689299 0.962872Winzorized Mean (23/86) 234.715935 296.006220 0.792943Winzorized Mean (24/86) 282.444388 280.231325 1.007897Winzorized Mean (25/86) 409.637305 253.330006 1.617011Winzorized Mean (26/86) 350.477256 246.015659 1.424614Winzorized Mean (27/86) 508.000404 217.923223 2.331098Winzorized Mean (28/86) 467.260087 211.271297 2.211659Winzorized Mean (29/86) 567.845783 192.165905 2.954977Trimmed Mean (0/86) 329.634309 658.438505 0.500630Trimmed Mean (1/86) 341.794390 581.303071 0.587980Trimmed Mean (2/86) 327.663073 540.093895 0.606678Trimmed Mean (3/86) 373.244590 518.128362 0.720371Trimmed Mean (4/86) 388.068268 502.531278 0.772227Trimmed Mean (5/86) 394.757249 489.236557 0.806884Trimmed Mean (6/86) 400.111992 474.220161 0.843726Trimmed Mean (7/86) 407.951038 457.585144 0.891530Trimmed Mean (8/86) 413.014639 439.318196 0.940126Trimmed Mean (9/86) 429.100742 422.853498 1.014774Trimmed Mean (10/86) 442.136061 411.303327 1.074963Trimmed Mean (11/86) 459.312525 399.182780 1.150632Trimmed Mean (12/86) 471.873969 386.623424 1.220500Trimmed Mean (13/86) 470.190428 376.956384 1.247334Trimmed Mean (14/86) 465.462157 369.578416 1.259441Trimmed Mean (15/86) 460.018804 361.256276 1.273386Trimmed Mean (16/86) 462.053448 353.755087 1.306139

Trimmed Mean (17/86) 464.377036 344.462320 1.348121Trimmed Mean (18/86) 474.841464 335.128362 1.416894Trimmed Mean (19/86) 486.078462 325.933660 1.491342Trimmed Mean (20/86) 499.498720 316.684450 1.577276Trimmed Mean (21/86) 517.341646 307.517636 1.682315Trimmed Mean (22/86) 534.045947 297.334991 1.796109Trimmed Mean (23/86) 556.907182 284.987521 1.954146Trimmed Mean (24/86) 588.610211 272.015720 2.163883Trimmed Mean (25/86) 619.085050 258.366196 2.396153Trimmed Mean (26/86) 640.276234 247.209958 2.590010Trimmed Mean (27/86) 670.231416 233.146258 2.874725Trimmed Mean (28/86) 687.455944 222.275627 3.092808Trimmed Mean (29/86) 711.610081 208.051030 3.420363Median 807.761539Midrange -181.089087Midmean 529.372847Observations 86

De bovenstaande bevindingen worden gestaafd door de twee onderstaande grafieken. Naarmate er meer outliers weggelaten worden, krijgen we een verslechtering van de wisorized en trimmed mean. Normaal gezien moet de X-as gelegen zijn tussen de twee gele lijnen. Dit is hier het geval.

Step 4: How could we describe (compute) the 50% confidence interval (of a 1-step-ahead forecast) based on variability, quartiles, and percentiles? What computation would you use to derive the 83% confidence interval?Wat betreft de variability kan men kijken naar het verschil tussen de variabiliteitsmaatstaven ten aanzien van het gemiddelde en dezelfde maatstaven ten aanzien van de mediaan. Indien beide sterk van elkaar verschillen, zal je niet te maken hebben met een normaalverdeling. Omdat de Mean Absolute Deviation (MAD), Median Absolute Deviation en Mean Squared Deviation van de mediaan en het gemiddelde nagenoeg aan elkaar gelijk zijn, kan men dus stellen dat er sprake is van een normaalverdeling of dat de verdeling van de residu’s op zijn minst de normaalverdeling benadert.

Variability - Ungrouped DataVariability Measure ValueAbsolute Range 40316.778073Relative Range (unbiased) 6.602697

Relative Range (biased) 6.641423Variance (unbiased) 3.72845e+7Trimmed, Unbiased Variance (0/86) 3.72845e+7Trimmed, Unbiased Variance (1/86) 2.83849e+7Trimmed, Unbiased Variance (2/86) 2.39195e+7Trimmed, Unbiased Variance (3/86) 2.14785e+7Trimmed, Unbiased Variance (4/86) 1.97014e+7Trimmed, Unbiased Variance (5/86) 1.81951e+7Trimmed, Unbiased Variance (6/86) 1.66465e+7Trimmed, Unbiased Variance (7/86) 1.50819e+7Trimmed, Unbiased Variance (8/86) 1.35171e+7Trimmed, Unbiased Variance (9/86) 1.21688e+7Trimmed, Unbiased Variance (10/86) 1.11781e+7Trimmed, Unbiased Variance (11/86) 1.02153e+7Trimmed, Unbiased Variance (12/86) 9.28818e+6Trimmed, Unbiased Variance (13/86) 8.54586e+6Trimmed, Unbiased Variance (14/86) 7.94089e+6Trimmed, Unbiased Variance (15/86) 7.32565e+6Trimmed, Unbiased Variance (16/86) 6.77557e+6Trimmed, Unbiased Variance (17/86) 6.18853e+6Trimmed, Unbiased Variance (18/86) 5.63707e+6Trimmed, Unbiased Variance (19/86) 5.12417e+6Trimmed, Unbiased Variance (20/86) 4.64279e+6Trimmed, Unbiased Variance (21/86) 4.19701e+6Trimmed, Unbiased Variance (22/86) 3.75594e+6Trimmed, Unbiased Variance (23/86) 3.30169e+6Trimmed, Unbiased Variance (24/86) 2.88060e+6Trimmed, Unbiased Variance (25/86) 2.48929e+6Trimmed, Unbiased Variance (26/86) 2.17726e+6Trimmed, Unbiased Variance (27/86) 1.85918e+6Trimmed, Unbiased Variance (28/86) 1.61464e+6Trimmed, Unbiased Variance (29/86) 1.36330e+6Variance (biased) 3.68510e+7Standard Error (unbiased) 6106.107497Standard Error (biased) 6070.503068Coefficient of Variation (unbiased) 18.523883Coefficient of Variation (biased) 18.415871Mean Squared Error (MSE versus 0) 3.69597e+7Mean Squared Error (MSE versus Mean) 3.68510e+7Mean Absolute Deviation from Mean (MAD Mean) 4527.704373Mean Absolute Deviation from Median (MAD Median) 4487.064867Median Absolute Deviation from Mean 3739.875780Median Absolute Deviation from Median 3716.562021

Mean Squared Deviation from Mean 3.68510e+7Mean Squared Deviation from Median 3.70796e+7Interquartile Difference (Weighted Average at Xnp) 7273.740578Interquartile Difference (Weighted Average at X(n+1)p) 7334.943068Interquartile Difference (Empirical Distribution Function) 7269.714848Interquartile Difference (Empirical Distribution Function - Averaging) 7269.714848Interquartile Difference (Empirical Distribution Function - Interpolation) 7223.578909Interquartile Difference (Closest Observation) 7269.714848Interquartile Difference (True Basic - Statistics Graphics Toolkit) 7465.399506Interquartile Difference (MS Excel (old versions)) 7269.714848Semi Interquartile Range (Weighted Average at Xnp) 3636.870289Semi Interquartile Range (Weighted Average at X(n+1)p) 3667.471534Semi Interquartile Range (Empirical Distribution Function) 3634.857424Semi Interquartile Range (Empirical Distribution Function - Averaging) 3634.857424Semi Interquartile Range (Empirical Distribution Function - Interpolation) 3611.789455Semi Interquartile Range (Closest Observation) 3634.857424Semi Interquartile Range (True Basic - Statistics Graphics Toolkit) 3732.699753Semi Interquartile Range (MS Excel (old versions)) 3634.857424Coefficent of Quartile Variation (Weighted Average at Xnp) 49.456009Coefficent of Quartile Variation (Weighted Average at X(n+1)p) 24.183457Coefficent of Quartile Variation (Empirical Distribution Function) 21.824247Coefficent of Quartile Variation (Empirical Distribution Function - Averaging) 21.824247Coefficent of Quartile Variation (Empirical Distribution Function - Interpolation) 25.061195Coefficent of Quartile Variation (Closest Observation) 21.824247Coefficent of Quartile Variation (True Basic - Statistics Graphics Toolkit) 30.632662Coefficent of Quartile Variation (MS Excel (old versions)) 21.824247Number of all Pairs of Observations 3655.000000Squared Differences between all Pairs of Observations 7.45691e+7Mean Absolute Differences between all Pairs of Observations 6660.370461Gini's Mean Difference 6660.370461Leik's Measure of Dispersion -9.102666Index of Diversity -2.955167Index of Qualitative Variation -2.989933Coefficient of Dispersion 5.554938Observations 86

Quartiles - Ungrouped DataMethod Quartile 1 Quartile 2 Quartile 3Weighted Average at Xnp -3563.332809 806.647267 3710.407769Weighted Average at X(n+1)p -3515.819452 807.761539 3819.123616Empirical Distribution Function -3468.306094 806.647267 3801.408754Empirical Distribution Function - Averaging -3468.306094 807.761539 3801.408754Empirical Distribution Function - Interpolation -3467.670648 807.761539 3755.908261

Closest Observation -3468.306094 806.647267 3801.408754True Basic - Statistics Graphics Toolkit -3610.846167 807.761539 3854.553339MS Excel (old versions) -3468.306094 807.761539 3801.408754Observations 86

Wil het verloop van de residu’s niet afwijken van dit van de normaalverdeling, moet de absolute waarde van het eerste en derde kwartiel min of meer aan elkaar gelijk zijn. Daarenboven moet het tweede kwartiel ongeveer gelijk zijn aan nul. Uit de bovenstaande tabel kan men aflezen dat niet aan deze voorwaarden werd voldaan. Op het vlak van de quartielen ben ik dus niet geneigd om te spreken van een normaalverdeling.

De onder- en bovengrens van het 50% betrouwbaarheidsinterval zijn respectievelijk gelijk aan kwartiel één (Q1) en kwartiel drie (Q3). Immers, Q1 bevat 25% en Q3 75% van de waarnemingsgetallen, met als gevolg dat het interval [Q1; Q3] of in dit geval het interval [-3563.332809; 3710.407769] vijftig procent van de waarnemingsgetallen bevat. De breedte van het 50% betrouwbaarheidsinterval is bijgevolg gelijk aan 7273.74. Dit getal kan ook afgelezen worden uit Variability-tabel (dit werd groen gemarkeerd). Het 83% betrouwbaarheidsinterval kan men aan de hand van de kwartielen echter niet berekenen.

Percentiles - Ungrouped Data

%Weighted

Average at Xnp

Weighted Average at

X(n+1)p

Empirical Distribution

Function

Empirical Distribution Function - Averaging

Empirical Distribution Function -

Interpolation

Closest Observation

True Basic - Statistics Graphics Toolkit

MS Excel (old

versions)

0.02 -1.544e+4 -1.530e+4 -1.353e+4 -1.353e+4 -1.268e+4 -1.353e+4 -1.857e+4 -1.353e+40.04 -1.115e+4 -1.104e+4 -9671.1692 -9671.1692 -9239.7053 -1.231e+4 -1.094e+4 -1.231e+4

0.06 -8569.1164

-8560.3440 -8446.3024 -8446.3024 -8439.2693 -8592.5096 -8478.4680 -

8592.5096

0.08 -8384.4113

-8378.7849 -8375.9716 -8375.9716 -8138.6799 -8375.9716 -8443.4892 -

8375.9716

0.10 -7900.0411

-7870.1552 -7780.4972 -7780.4972 -7217.0686 -7780.4972 -7989.6991 -

7780.4972

0.12 -6615.7515

-6601.5432 -6535.2382 -6535.2382 -6453.9594 -6653.6401 -6587.3350 -

6653.6401

0.14 -6086.0425

-5936.2356 -5058.7951 -5058.7951 -5165.8000 -6128.8445 -5251.4040 -

6128.8445

0.16 -4606.1650

-4510.8745 -4463.2292 -4463.2292 -4401.1473 -4463.2292 -5011.1498 -

4463.2292

0.18 -4318.7636

-4303.3902 -4274.3515 -4274.3515 -4270.3318 -4359.7594 -4330.7207 -

4274.3515

0.20 -4255.5286

-4250.1046 -4233.8328 -4233.8328 -4233.8328 -4260.9525 -4244.6807 -

4260.9525

0.22 -4017.7633

-3973.0886 -3998.9746 -3998.9746 -3869.5446 -3998.9746 -3839.9605 -

3998.9746

0.24 -3714.4169

-3677.0453 -3658.3595 -3658.3595 -3582.3382 -3658.3595 -3795.3887 -

3658.3595

0.26 -3467.3911

-3466.7302 -3465.7643 -3465.7643 -3454.6597 -3468.3061 -3467.3402 -

3465.7643

0.28 -3331.5834

-3250.6100 -3065.5279 -3065.5279 -3123.3661 -3354.7186 -3169.6366 -

3354.7186

0.30 -2616.2356

-2503.4864 -2503.9125 -2503.9125 -2501.7820 -2503.9125 -2500.0776 -

2503.9125

0.32 -2193.8273

-2005.6278 -1911.5280 -1911.5280 -1906.9104 -1911.5280 -2405.5518 -

1911.5280

0.34 -1799.7886

-1674.1989 -1519.0588 -1519.0588 -1555.9970 -1888.4400 -1733.2999 -

1519.0588

0.36 -1251.4950

-1217.1457 -1240.3465 -1240.3465 -1196.8450 -1240.3465 -1191.0447 -

1240.34650.38 -937.4134 -811.6535 -828.9756 -828.9756 -742.3652 -828.9756 -557.5965 -828.97560.40 -535.1024 -529.9303 -527.3443 -527.3443 -527.3443 -540.2744 -537.6884 -527.34430.42 -94.4824 41.1269 189.6513 189.6513 92.7875 -133.2279 15.2965 189.65130.44 339.4289 402.3645 367.9579 367.9579 417.1102 367.9579 456.4321 367.95790.46 556.0470 608.1874 607.2821 607.2821 611.8087 607.2821 651.6427 607.28210.48 693.8431 764.6348 800.0307 800.0307 770.5341 652.5480 687.9438 800.03070.50 806.6473 807.7615 806.6473 807.7615 807.7615 806.6473 807.7615 807.76150.52 910.6843 966.0376 950.2765 950.2765 963.4107 950.2765 1000.1867 950.27650.54 1132.3211 1275.1430 1280.4327 1280.4327 1253.9842 1015.9478 1021.2375 1280.43270.56 1369.6082 1392.5386 1404.0038 1404.0038 1387.6249 1363.0566 1374.5218 1404.00380.58 1425.8129 1502.9919 1428.7869 1428.7869 1477.1814 1428.7869 1515.8971 1428.78690.60 1598.0898 1616.4457 1603.4149 1603.4149 1603.4149 1603.4149 1655.5380 1603.41490.62 1692.9453 1740.1748 1744.7454 1744.7454 1721.8924 1668.5688 1673.1394 1744.74540.64 2217.0008 2327.6385 2382.9573 2382.9573 2279.2345 2210.0859 2265.4048 2382.95730.66 2484.0268 2545.8024 2515.9435 2515.9435 2523.0528 2515.9435 2557.1772 2515.94350.68 2658.1812 2749.0763 2735.2550 2735.2550 2705.6113 2587.0361 2807.8168 2735.25500.70 2861.6270 3001.5879 3021.5823 3021.5823 2921.6102 2821.6381 2841.6326 3021.58230.72 3135.7284 3221.2790 3145.6542 3145.6542 3169.2869 3145.6542 3188.1931 3263.81790.74 3491.3948 3688.5675 3619.4068 3619.4068 3583.8479 3619.4068 3732.2480 3619.40680.76 3826.9182 3907.8640 3872.2682 3872.2682 3843.9244 3801.4088 4133.3038 3872.26820.78 4188.1302 4375.6282 4409.2816 4409.2816 4241.0142 4168.8996 4202.5531 4409.28160.80 4593.3487 4894.2859 4639.3655 4639.3655 4639.3655 4639.3655 4809.3124 5064.23280.82 5074.7813 5258.2560 5084.5183 5084.5183 5078.4327 5084.5183 5421.7738 5084.51830.84 5615.2727 5711.9062 5677.8497 5677.8497 5628.4468 5595.5115 6069.4990 5677.84970.86 6086.5272 6238.9412 6103.5554 6103.5554 6120.0659 6103.5554 6133.2743 6268.66000.88 6303.7185 6505.7411 6320.2166 6320.2166 6309.9053 6320.2166 6465.9859 6651.51050.90 6995.9749 7821.1122 7512.6715 7512.6715 7082.0910 6651.5105 8232.3664 7512.67150.92 8549.3243 8620.8956 8611.7843 8611.7843 8555.0025 8540.8070 8830.4546 8611.78430.94 8803.1208 8855.7257 8839.5659 8839.5659 8816.7877 8839.5659 8844.1238 8860.28360.96 9084.9152 9292.6406 9261.4115 9261.4115 9100.9603 9261.4115 9290.2383 9321.46740.98 1.102e+4 1.657e+4 1.537e+4 1.537e+4 1.114e+4 9321.4674 1.878e+4 1.537e+4

Wat de bespreking van de percentielen betreft, baseer ik mij op op de “Empirical Distribution Function - Interpolation”. Het p-de percentiel met waarde x dient men te interpreteren als het percentage (p) van de waarnemingsgetallen dat kleiner of gelijk

is aan deze waarde. Zo is bijvoorbeeld 50% (p = 0.5) van de waarnemingsgetallen kleiner of gelijk aan 807.7615.

Om te spreken van een normaalverdeling moet de overgang tussen min en plus ongeveer bij het vijftigste percentiel plaatsvinden. Deze overgang treffen we echter al aan bij het 40ste en 42ste percentiel en is aan deze voorwaarde dus niet voldaan. Ook het gelijk zijn aan nul treft men hier aan. Daarnaast moeten de absolute waarden van een percentiel (%) en zijn complement (1 - %) ook ongeveer met elkaar overeenstemmen. Zo is de absolute waarde van het 24e percentiel (p = 0.25) gelijk aan 3582.3382, terwijl het 74e percentiel (p = 0.75) een absolute waarde heeft van 3583.8479. Beide absolute waarden liggen dicht bij elkaar.

Ook uit onderstaande QQ Plot kan men besluiten dat de puntenwolk vrij dicht bij de diagonaal aansluit.

Step 5: Are the residuals of the time series white noise?

De meeste analyses tonen toch aan dat de residu’s normaal verdeeld zijn, waardoor mag geconcludeerd worden dat er sprake is van white noise.

Step 6: Create scatterplots between the (white noise) residuals of your selected time series (with various timelags). Is there ANY relationship between the series? Do your findings correspond to your initial hypotheses? Did you now solve the spurious (nonsense) correlation problem?*

Warning: the residual series will probably not have equal length - align them at the last estimated value!

*This analysis should not be viewed as completely adequate (it is not exactly the same as "prewhitening"). In the context of this workshop we are not going to discuss the prewhitening mechanism.

Ik ga enkel het scatterplot tussen de white noise residuals weergeven, die op mijn hypothese betrekking heeft. Voor de residu’s van mijn drie andere tijdreeken werd niet voor een uitgebreide bespreking gekozen, omdat de analyse steeds op hetzelfde neerkomt. Mijn eerder geformuleerde hypothese was de volgende:

- Zullen de werkloosheidsgraden van mannen en vrouwen in de toekomst op een gelijk niveau blijven?

Uit onderstaande grafiek kan worden afgeleid dat de werkloosheidsgraden van mannen en vrouwen wel degelijk gelijk zullen tenderen, aangezien de puntenwolk op zich bij elkaar concentreren.

Resids werkloze mannen vs. werkloze vrouwen

-3

-2

-1

0

1

2

3

-1,5 -1 -0,5 0 0,5 1Series1

Related Documents