OPERADOR LOGISTICO CORPORACIÓN UNIVERSITARIA REMINGTON CREAD BOGOTA CIES FACULTAD DE CIENCIAS EMPRESARIALES ESCUELA DE CIENCIAS EMPRESARIALES NÚCLEO DE FORMACIÓN ESPECÍFICA CARTILLA DE TRABAJO CUARTA SESIÓN ECONOMETRIA DE NEGOCIOS Elaborada por DANIEL ANTONIO GOMEZ TAMARA ECONOMISTA ESP. COMERCIO EXTERIOR Y ECONOMIA INTERNACIONAL DEPARTAMENTO DE PUBLICACIONES BOGOTA D.C. 1

Welcome message from author

This document is posted to help you gain knowledge. Please leave a comment to let me know what you think about it! Share it to your friends and learn new things together.

Transcript

CORPORACIÓN UNIVERSITARIA REMINGTON

CREAD BOGOTA CIES

FACULTAD DE CIENCIAS EMPRESARIALES

ESCUELA DE CIENCIAS EMPRESARIALES

NÚCLEO DE FORMACIÓN ESPECÍFICA

CARTILLA DE TRABAJO

CUARTA SESIÓN

ECONOMETRIA DE NEGOCIOS

Elaborada por

DANIEL ANTONIO GOMEZ TAMARA

ECONOMISTA

ESP. COMERCIO EXTERIOR Y ECONOMIA INTERNACIONAL

DEPARTAMENTO DE PUBLICACIONES

BOGOTA D.C.

2013

CUADRO 1. CONTROL DEL DOCUMENTO

PARTICIPANTES

NOMBRE

CARGO

DEPENDENCIA

FECHA

Autor

DANIEL ANTONIO GOMEZ TAMARA

Docente

1/2013

Revisión

LUIS EDUARDO RODRÍGUEZ

Director Académico

Académica

1/2013

Aprobación

CUADRO 2. CONTROL DE ESTADO DE PREPARACIÓN DE LA CARTILLA EDUCACIÓN A DISTANCIA

VERSIÓN No.

FECHA DE FINALIZACIÓN DE SU ELABORACIÓN

DESCRIPCIÓN DEL CAMBIO

SOLICITADO POR:

01

23/01/2013

Construcción de las cartillas de Econometría de Negocios en la Corporación Iberoamericana de Estudios CIES en función a su cadena de valor con el fin de asegurar la calidad de sus servicios.

Consejo Superior.

NOMBRE : ____________________________________________

C.C. : ___________________________________________

CARRERA : ____________________________________________

JORNADA : MARTES Y MIERCOLES ( ) AM____ PM____

JUEVES Y VIERNES ( ) AM____ PM____

SÁBADOS ( ) AM____ PM____

DOMINGOS ( )

NOMBRE DEL PROFESOR

: ________________________

FECHA

: ________________________

CALIFICACIÓN

: ________________________

__________________________

Firma Docente

Sr. Docente : No firme la cartilla sino está debidamente diligenciada en todos sus campos.

DERECHOS DEL ESTUDIANTE EN EL AULA DE CLASE

· Exigir el uso de la cartilla

· Exigir firma y sello de la cartilla por parte del docente.

· Exigir sus notas al final del módulo.

NINGUNA RECLAMACIÓN SERA ACEPTADA SI SU CARTILLA NO ESTÁ DILIGENCIADA EN TODOS SUS CAMPOS, CON FIRMA Y SELLO DEL DOCENTE CORRESPONDIENTE.

INTRODUCCIÓN

El modelo de dos variables, estudiado en las guías anteriores, con frecuencia es inadecuado en la práctica. Es el caso del ejemplo consumo-ingreso, en donde se supone implícitamente que solamente el ingreso X afecta el consumo Y. Pero la teoría económica rara vez es tan simple, ya que, además del ingreso existen muchas otras variables que probablemente afectan el gasto de consumo, por ejemplo, la riqueza del consumidor, para citar otro ejemplo, es probable que la demanda de un bien dependa no solo de su propio precio sino también de los precios de otros bienes competitivos o complementarios, del ingreso del consumidor, de la condición social, entre otros.

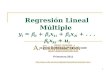

De acuerdo a lo anterior, se necesita ampliar el modelo simple de regresión con dos variables para considerar modelos que contengan más de dos variables. La adición de variables conduce al análisis de los modelos de regresión múltiple, es decir, a modelos en los cuales la variable dependiente, o regresada, Y, depende de dos o más variables explicativas, o regresoras.

En esta cuarta unidad se considerará el modelo de regresión múltiple, el cual tiene por objeto estimar la relación funcional entre más de dos variables, mediante el uso de una de las herramientas de la estadística más simple de usar para la estimación de los parámetros.

El modelo de regresión múltiple más simple posible es la regresión de tres variables, con una variable dependiente y dos variables explicativas. En esta unidad se estudiara este modelo. Durante todo el análisis, se tratara con modelos de regresión múltiple, es decir, modelos lineales en los parámetros; que pueden ser o no lineales en las variables.

CONTENIDOS CUARTA SESIÓN.

Contenido

5INTRODUCCIÓN

71.DISEÑO METODOLÓGICO SESIÓN CUATRO

71.1.OBJETIVO

71.2.JUSTIFICACIÓN.

81.3.METODOLOGÍA.

92.MODELO DE REGRESIÓN LINEAL (continuación)

92.1.ERROR ESTANDAR DE LA ESTIMACIÓN

102.2.INTERVALO DE PREDICCIÓN

132.3.INTERVALO DE CONFIANZA

162.4.ANALISIS DE VARIANZA

183.REGRESIÓN LINEAL MÚLTIPLE

213.1.MODELOS DE ECUACIONES LINEALES DE REGRESION MUL.

223.2.LAS ECUACIONES DE MINIMOS CUADRADOS

253.3.DEFICIENCIAS MUESTRALES: MULTICOLINEALIDAD Y

30ACTIVIDAD UNO INDIVIDUAL

324.SESION PRACTICA CON E-VIEWS

324.1.CAMBIO DE FRECUENCIA EN SERIES DE DATOS AGREGACI

364.2.CARACTERIZACIÓN DE SERIES. ESTADÍSTICOS BÁSICOS Y

405.GLOSARIO

447.FUENTES DIGITALES O ELECTRÓNICAS

1. DISEÑO METODOLÓGICO SESIÓN CUATRO

1.1. OBJETIVO

Especificar y resolver el sistema de ecuaciones normales para estimar por mínimos cuadrados diferentes ecuaciones de regresión. La regresión por mínimos cuadrados, es una técnica cuyo objetivo es derivar una curva que minimice la discrepancia entre los puntos y la curva.

1.2. JUSTIFICACIÓN.

En esta guía se presentan las técnicas de regresión, que tienen como propósito modelizar, es decir, encontrar una función que aproxime lo máximo posible la relación de dependencia estadística entre variables y predecir los valores de una de ellas: y (variable dependiente) a partir de los de la otra ( o las otras): x (variable (s) independiente (s)). La regresión es lineal cuando el modelo función de regresión seleccionado es una recta.

El éxito del análisis de regresión depende de la disponibilidad de la información apropiada y en esta guía se analizara la naturaleza, las fuentes y limitaciones de los datos que están disponibles para la investigación, especialmente en la ciencia económica.

1.3. METODOLOGÍA.

El desarrollo metodológico que se utilizará es de teórico – práctico con el fin que el estudiante pueda desarrollar y aplicar la temática de los fundamentos en econometría dentro de la teoría económica, la economía matemática, la estadística matemática y la estadística económica, a través de ejercicios de reconocimiento de diferentes procesos de la formación de los espacios econométricos y su influencia en el campo empresarial, lo que permitirá afianzar y potencializar una de las herramientas de gran aplicación en el campo de la economía y de otras ciencias sociales.

2. MODELO DE REGRESIÓN LINEAL (continuación)

2.1. ERROR ESTANDAR DE LA ESTIMACIÓN

El error estándar nos permite deducir la confiabilidad de la ecuación de regresión que hemos desarrollado. Este error se simboliza Sxy y es similar a la desviación estándar en cuanto a que ambas son medidas de dispersión.

El error estándar de la estimación mide la variabilidad, o dispersión de los valores observados alrededor de la línea de regresión. El error estándar de estimación se calcula con la finalidad de medir la confiabilidad de la ecuación de la estimación.

El error estándar de estimación permite medir la variabilidad o dispersión de los valores de (y) los cuales encontramos en la muestra, alrededor de la línea recta de regresión. El resultado que se obtiene del cálculo del error estándar de estimación se expresa en término de los valores de la variable dependiente Yi.

En resumen, la desviación estándar de un conjunto de datos se usa para medir la variabilidad o la dispersión de los datos, alrededor de la media. El error estándar de la estimación se usa para medir la variabilidad o la dispersión de los valores pronosticados por la ecuación de regresión y los valores de Y reales. Esto se puede observar en la formula del error estándar de la estimación:

Ejemplo: (continuación del ejemplo de módulos anteriores)

Una tienda de computadores llevó a cabo un estudio para determinar la relación entre la cantidad de productos comprados por los clientes mensuales y las ventas. Con los datos de la tabla, se pide encontrar el error estándar de la estimación.

2.2. INTERVALO DE PREDICCIÓN

Un intervalo de predicción es un intervalo elaborado con una serie de datos de las muestras de modo que contenga observaciones futuras. Tenga en cuenta que éste es un problema diferente a la elaboración de un intervalo para el promedio con cierto grado de confianza. Supongamos que una futura muestra se toma en las mismas condiciones y de la misma población o proceso que la muestra original y que la muestra era aleatoria o que el proceso estaba en condiciones de control estadístico. Hay muchas variaciones sobre este tema, pero todas tienen que ver con el problema esencial de lo que pasará en el futuro y con qué frecuencia sucederá, la esencia de la estadística. Podemos tener intervalos de predicción para los datos de las variables, o para datos del tipo de atributo; podemos basar más la predicción en un modelo paramétrico, como la distribución normal o usar métodos no paramétricos. Ambos son útiles en la práctica. También podemos poner condiciones sobre la predicción futura.

En otras palabras, una estimación puntual no proporciona información sobre la distancia a la que se encuentra del parámetro poblacional. Para determinar esta información, se desarrolla una predicción o intervalo de confianza. De hecho, los analistas pueden elegir entre dos tipos de intervalos: intervalo de predicción para un valor especifico de Y. Intervalo de confianza para el valor esperado de Y para un valor dado de X.

El error estándar estimado del pronostico es una estimación de la desviación estándar de la distribución muestral para el estimador Y.

Ejemplo: (continuación del ejemplo de módulos anteriores)

Con respecto a la tienda de computadores se desea estimar las ventas del próximo mes en el caso de la cantidad de productos comprados por los clientes mensuales se incrementarán 55. Usando los datos y la ecuación de regresión calculada, se solicita desarrollar una estimación puntual para dichas ventas:

El intervalo de predicción:

El intervalo de predicción del 95% para las ventas de la próxima semana en el caso de que los gastos de publicidad se incrementarán 55, estará dentro del intervalo del 391,77 y 660,33, donde se encuentra el valor de Y estimado.

2.3. INTERVALO DE CONFIANZA

En estadística, se llama intervalo de confianza a un par de números entre los cuales se estima que estará cierto valor desconocido con una determinada probabilidad de acierto. Formalmente, estos números determinan un intervalo, que se calcula a partir de datos de una muestra, y el valor desconocido es un parámetro poblacional. La probabilidad de éxito en la estimación se representa con 1 - α y se denomina nivel de confianza. En estas circunstancias, α es el llamado error aleatorio o nivel de significación, esto es, una medida de las posibilidades de fallar en la estimación mediante tal intervalo.

El nivel de confianza y la amplitud del intervalo varían conjuntamente, de forma que un intervalo más amplio tendrá más posibilidades de acierto (mayor nivel de confianza), mientras que para un intervalo más pequeño, que ofrece una estimación más precisa, aumentan sus posibilidades de error.

Para la construcción de un determinado intervalo de confianza es necesario conocer la distribución teórica que sigue el parámetro a estimar, θ. Es habitual que el parámetro presente una distribución normal. También pueden construirse intervalos de confianza con la desigualdad de Chiebyshev.

En definitiva, un intervalo de confianza al 1 - α por ciento para la estimación de un parámetro poblacional θ que sigue una determinada distribución de probabilidad, es una expresión del tipo [θ1,θ2] tal que P[θ1 ≤ θ ≤ θ2] = 1 - α, donde P es la función de distribución de probabilidad de θ.

El intervalo de confianza se utiliza para estimar el valor medio de y para un valor específico de x.

El error estándar estimado del pronostico es una estimación de la desviación estándar de la distribución muestral para el estimador y:

Ejemplo: (continuación del ejemplo de módulos anteriores)

Con respecto a la tienda de computadores se desea obtener un intervalo de 95% de confianza para las ventas media mensual cuando se incremente la cantidad de productos comprados por los clientes mensualmente.

El intervalo de confianza:

El intervalo de confianza del 95% para las ventas media de la próxima semana en el caso de que la cantidad de productos comprados por los clientes mensualmente se incrementarán 55, estará dentro del intervalo de 456,27 y 595.83, donde se encuentra el valor de y estimado.

2.4. ANALISIS DE VARIANZA

En estadística, el análisis de la varianza (ANOVA, ANalysis Of VAriance, según terminología inglesa) es una colección de modelos estadísticos y sus procedimientos asociados, en el cual la varianza está particionada en ciertos componentes debidos a diferentes variables explicativas.

Las técnicas iniciales del análisis de varianza fueron desarrolladas por el estadístico y genetista R. A. Fisher en los años 1920 y 1930 y es algunas veces conocido como "Anova de Fisher" o "análisis de varianza de Fisher", debido al uso de la distribución F de Fisher como parte del contraste de hipótesis.

Otro estadístico importante en el análisis de regresión es el estadístico F, que se usa para probar la hipótesis nula de que la ecuación de regresión muestral no explica un porcentaje significativo de la varianza de la variable Y. La hipótesis nula y alternativa son:

El estadístico de prueba para la hipótesis nula establecida se obtiene de la distribución F si la hipótesis nula es cierta.

TABLA DE ANÁLISIS DE VARIANZA (ANOVA)

El estadístico de la prueba F:

EJEMPLO (Continuación del ejemplo de la guía anterior almacén de computadores)

Una tienda de computadores llevó a cabo un estudio para determinar la relación entre la cantidad de productos comprados por los clientes mensuales y las ventas. Se pide determinar la hipótesis para la pendiente.

El estadístico de la prueba para la hipótesis nula establecida se obtiene de la distribución F si la hipótesis nula es cierta.

TABLA DE ANÁLISIS DE VARIANZA (ANOVA)

Por tanto, se rechaza la hipótesis nula. Con muy poca probabilidad de error. Se concluye que la ecuación de regresión explica un porcentaje significativo de la varianza de las ventas.

3. REGRESIÓN LINEAL MÚLTIPLE

Pasamos a continuación a generalizar el modelo anterior al caso de un modelo con varias variables exógenas, de tal forma que se trata de determinar la relación que existe entre la variable endógena Y y variables exógenas, X1 ,X2,…, Xk. Dicho modelo se puede formular matricialmente de la siguiente manera:

Si en la expresión anterior se considerará que existe término independiente, α, la matriz X quedaría como:

Y el modelo quedaría así:

Suponiendo que se verifican las hipótesis que veíamos antes, el problema a resolver nuevamente es la minimización de la suma de cuadrados e los termins de error tal que:

Desarrollando dicho cuadrado y derivando respecto a cada β1 obtenemos el siguiente sistema de ecuaciones expresado en notación matricial:

En donde basta con despejar β premultiplicando ambos miembros por la inversa de la matriz (X’ X) para obtener la estimación de los parámetros del modelo tal que:

Si en el modelo existiera termino independiente, α, las matrices anteriores serian:

El resultado de multiplicar dichas matrices conduce a la obtención de la estimación de los parámetros β1 del modelo:

Cada uno de los coeficientes estimados, son una estimación insesgada del verdadero parámetro del modelo y representa la variación que experimenta la variable dependiente Y cuando una variable independiente Xiβˆi varía en una unidad y todas las demás permanecen constantes (supuesto ceteris paribus). Dichos coeficientes poseen propiedades estadísticas muy interesantes ya que, si se verifican los supuestos antes comentados, son insesgados, eficientes y óptimos.

En resumen, los modelos de análisis de regresión multiple son similares a los modelos de regresión lineal simple, excepto en que se tienen mas de una variable independiente y pueden llegar a tener un mayor grado de complejidad en el análisis del modelo y en la relación de la línea recta ajustada a la regresión.

3.1. MODELOS DE ECUACIONES LINEALES DE REGRESION MULTIPLE

E (Y)= β0 + β1X1 + β2X2

Los supuestos del modelo de análisis de regresión son los siguientes:

3.1.1. La media de e es 0. Esto implica que la media de y equivale al componente determinísticos del modelo, esto es,

E (y)= β0 + β1X1 + β2X2+…+ βkXk

3.1.2. Para todos los valores de las variables independientes X1, x2, …, Xk, la varianza de E es constante.

3.1.3. La distribución de probabilidad de E es normal.

3.1.4. Los errores aleatorios son independientes.

3.2. LAS ECUACIONES DE MINIMOS CUADRADOS Y SU RESOLUCION

Para encontrar un modelo de regresión múltiple se utiliza el procedimiento de algebra lineal por medio de operaciones con matrices, teniendo en cuenta el siguiente modelo:

Ejemplo:

Se realizo un estudio en un supermercado sobre la congestión en la entrada de vehículos, para determinar el comportamiento de la entrada se tomaron las variables del numero de vehículos (x) y el tiempo de congestionamiento. Considere el modelo lineal y observe si existe o no la relación entre las variables.

La estimación de minimos cuadrados es:

Entonces

por último, determinar la inversa de la matriz.

Y la solución de la ecuación de mínimos cuadrados es entonces:

Por tanto, β0= -0,9 y β1=0,1 y la ecuación de predicción es:

E(y)= -0,9 + 0,1X

3.3. DEFICIENCIAS MUESTRALES: MULTICOLINEALIDAD Y ERRORES DE MEDIDA

3.3.1. Multicolinealidad:

El proceso o término de multicolinealidad en Econometría es una situación en la que se presenta una fuerte correlación entre variables explicativas del modelo. La correlación ha de ser fuerte, ya que siempre existirá correlación entre dos variables explicativas en un modelo, es decir, la no correlación de dos variables es un proceso idílico, que sólo se podría encontrar en condiciones de laboratorio.

El fenómeno de la multicolinealidad aparece cuando las variables exógenas de un modelo econométrico están correlacionadas entre sí, lo que tiene consecuencias negativas para la estimación por Mínimos Cuadrados Ordinarios pues, en ese caso, en la expresión:

la matriz (X’ X) no será invertible por lo que resultará imposible hallar la estimación de los parámetros del modelo y la varianza de los mismos. Esto es lo que se conoce por el nombre de multicolinealidad exacta.

Sin embargo, en la práctica no nos encontraremos con un caso tan extremo como el que acabamos de exponer, sino que generalmente nos encontraremos ante multicolinealidad aproximada, siendo una de las columnas de la matriz , (X’ X) aproximadamente, una combinación lineal del resto por lo que será una matriz aproximadamente singular. Al no ser el determinante de (X’ X) igual a cero, existirá inversa y podrán estimarse los parámetros pero no cuando las pequeñas variaciones muestrales producidas al incorporar o sustraer un número reducido de observaciones muestrales podrían generar importantes cambios en los parámetros estimados.

Las soluciones propuestas para resolver el problema de la multicolinealidad son variados, si bien en general resultan poco satisfactorios:

− Una posibilidad, sugerida por Johnston (1984) consiste en excluir aquella variable exógena que puede estar muy correlacionada con el resto y posteriormente estimar el coeficiente asociado a dicha variable mediante otro procedimiento para incluirlo en el modelo.

− También se ha sugerido la posibilidad de reformular el modelo, convirtiéndolo en un modelo de varias ecuaciones.

3.3.2. Errores de medida:

Cuando hablamos de errores en las variables nos referimos a los errores de medición de las mismas. Como el alumno ya debería conocer, al medir las relaciones existentes en Economía recurrimos a variables obtenidas, la mayoría de las veces por medio de estimaciones muestrales, esto es, a través de un muestreo representativo de las unidades que las generan (consumo interior de un país, producción, etc.) o derivadas de éstas (Producto Interior Bruto, etc.). Estas estimaciones de las variables macroeconómicas van asociadas a un error de muestreo. Las variables cuantificadas a través de muestreos representativos, no sólo se dan al trabajar con macromagnitudes, encontrándoselas también el investigador en todas las disciplinas (Marketing, Contabilidad, etc.)

Es importante, por tanto, que al efectuar cualquier tipo de investigación y análisis, se conozca la fuente y origen de los datos, así como sus características básicas (error de muestreo, nivel de confianza, tipo de muestreo, tamaños muestrales, universo de referencia, influencia o sesgo de la no respuesta, etc.).

El hecho de que los errores en las variables a medir existan, ha producido una controversia a lo largo del tiempo entre los económetras, existiendo partidarios de su tratamiento así como partidarios de no tenerlos en cuenta.

A estos errores se les propuso como los causantes de las discrepancias en los valores observados y la regresión, fundamentándose en la diferencia existente entre las variables teóricas y las variables empíricas.

La aceptación de la existencia de errores en la medición de las variables produce un problema de aceptación de inconsistencia en las estimaciones mínimo cuadráticas debido a que, evidentemente, si una variable esta medida con error éste se reflejará en la perturbación aleatoria, produciéndose una correlación entre ambos componentes de la ecuación.

En estos casos se utiliza la definición de variable latente, como la variable real, que no siempre coincidirá con la variable empírica u observada. La variable latente se describe como la variable observada más el término de error.

Llevado el problema a un modelo concreto, se puede observar como sustituyendo las variables a analizar (siempre se supone que se desea trabajar con variables reales “latentes”) por las variables observadas más el error de medida, se llega al problema descrito.

Este problema difiere en su magnitud según si el error se da en las variables explicativas o en las variables endógenas. Así, si sólo existen errores en la variable endógena, los estimadores mínimo cuadráticos serán insesgados y consistentes, pero presentarán un problema de eficiencia (se incrementa la varianza del error). Si, por el contrario, los errores de medición se encuentran en las variables explicativas del modelo, los estimadores mínimos cuadráticos serán sesgados e inconsistentes.

Otro hecho a tener en cuenta es que habitualmente no se conoce el valor real de la variable, no conociéndose, por tanto, el error cometido en su medición (estimación), debiendo el investigador trabajar con la variable observada, lo que conduce a la necesidad de trabajar con estimadores consistentes.

Actualmente existe una línea de investigación en la cual se trabaja con errores en las variables, conocida como el análisis de ecuaciones estructurales los cuales, partiendo del hecho de que no se miden perfectamente las variables latentes mediante la información disponible, incorporan dentro de su implementación los errores de medida. Dentro de esta línea de investigación cabe destacar los siguientes métodos:

· Método de Agrupación de las Observaciones, que consiste en la división de los valores muestrales en grupos o submuestras a partir de los cuales, una vez ordenados de menor a mayor los valores de la variable explicativa, se calculan las medias aritméticas, obteniéndose de esta manera tanto la pendiente como el término independiente. Los estimadores así obtenidos son consistentes, pero no eficientes.

· Método de Variables Instrumentales (VI), consiste en encontrar un instrumento o variable que, no estando incluida en el modelo, esté incorrelacionada con el término de error y correlacionada con la variable explicativa para la que actúa de instrumento y que posee errores de medida. El estimador obtenido de esta manera será un estimador consistente, si bien el método plantea ciertas dificultades, ya que es difícil encontrar en la práctica instrumentos de una variable medida con error que no estén correlacionados con el término de error.

· Método de la Regresión Ponderada, en la que se da una ponderación igual a los errores de X y de Y. Posteriormente, y una vez fijada la relación entre las varianzas de los errores, se procede a estimar X en función de Y, y de Y en función de X, debiendo encontrarse la regresión verdadera entre ambas estimaciones.

ACTIVIDAD UNO INDIVIDUAL

1. Un hipermercado ha decidido ampliar el negocio. Decide estudiar de forma exhaustiva el número de cajas registradoras que va a instalar, para evitar grandes colas. Para ello, se obtuvieron los siguientes datos procedentes de otros establecimientos similares acerca del número de cajas registradoras y del tiempo medio de espera.

Bajo el supuesto de que el tiempo de espera medio depende linealmente del número de cajas registradoras se pretende saber, e interpretar:

a) Realizar el diagrama de dispersión.

b) Realizar el coeficiente de correlación.

c) Realizar la prueba de hipótesis en el análisis de correlación con t del 95%.

d) Encontrar la ecuación de la línea recta de regresión muestral con el método de mínimos cuadrados

e) Encontrar la línea recta cuando x vale: 10, 12, 24.

f) Encontrar los residuales.

2. ¿Cómo define usted el concepto de regresión simple?

____________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________

3. ¿Cómo define usted el concepto de diagrama de dispersión y coeficiente de regresión?

______________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________

4. ¿Qué es un análisis de regresión múltiple?

______________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________________

4. SESION PRACTICA CON E-VIEWS

4.1. CAMBIO DE FRECUENCIA EN SERIES DE DATOS AGREGACIÓN DE DATOS

Una de las transformaciones con las que habitualmente nos podemos enfrentar a la hora de elaborar modelos econométricos basados en series temporales es, precisamente, los cambios en la frecuencia temporal con la que se presentan dichos datos.

Como ya se ha visto en las pasadas guías, estos cambios de frecuencia no presentan ningún problema siempre que estemos agregando información, es decir, que reduzcamos la frecuencia de las series temporales. Para realizar estas operaciones de agregación en Eviews, bastará con traspasar un objeto serie de un workfile de frecuencia superior a otro de frecuencia inferior, siendo las operaciones más habituales la agregación trimestral de series mensuales o la agregación anual de series trimestrales.

Este traspaso de series de unos workfiles a otros puede realizarse de dos formas alternativas:

· Almacenando en disco los objetos tipo serie mediante el comando Store y recuperándolos posteriormente en un workfile de menor frecuencia mediante el comando Fetch.

· Manteniendo abiertos simultáneamente los dos workfiles y utilizando las opciones de copiar (Copy) y pegar (Paste), a las que podemos acceder seleccionando el objeto a copiar y pulsando el botón derecho del ratón.

Para ilustrar esta operación, vamos a seleccionar dos series, denominadas respectivamente, ACTMUN y BASE, de un workfile denominado TRIMES95, y las copiaremos en un nuevo workfile, denominado anual, reduciendo así las citadas series de frecuencia trimestral a frecuencia anual.

Los pasos a seguir, tal como se ilustran en la imagen anterior serían los siguientes:

1. Activar los dos workfiles mediante la opción fichero (File) abrir (Open).

2. Seleccionar los objetos tipo serie que pretendemos cambiar de frecuencia.

3. Pulsar el botón derecho del ratón y seleccionar la opción de copiado (Copy). Situarnos en la ventana del workfile de destino y presionando nuevamente el botón derecho del ratón seleccionar la opción de pegado (Paste).

Tal como decíamos en antes, existen diversas alternativas para realizar la agregación de series (reducción de frecuencia), siendo las más habituales la de suma, media y último dato, en función del tipo de series que estemos manejando.

La selección del método de agregación utilizado por Eviews se realiza desde el menú principal del programa, eligiendo el menú de opciones (Options), y dentro de esta, la opción de conversión de frecuencias (Frequency Conversion –Dates), accediendo a un menú donde podremos seleccionar el tipo de agregación (High to low frequency conversión) deseada.

Como puede comprobarse en la siguiente figura, además de las opciones habituales de media (Average Observations), suma (Sum Observations) y último dato (Last Observation), podemos optar por agregar utilizando la primera observación (First Observation), el máximo (Maximun Observation), el mínimo (Minimun Observation) o no permitir la conversión de frecuencias (No conversión allowed).

Una vez seleccionada la opción de conversión, ésta actuará por defecto en todas las operaciones de cambio de frecuencia realizadas con Eviews hasta que se altere nuevamente mediante un proceso similar a éste.

Adicionalmente, a cada objeto serie puede asignársele un tipo de agregación específica con independencia de la opción general activada. Así, desde el menú específico de la ventana del objeto serie y la opción de ver (View) se puede acceder a un menú de opciones de conversión (conversión Options), que nos presenta una lista de opciones similar a la que veíamos en el caso general, con la diferencia de que esta selección específica sólo afectará a la serie concreta que hayamos seleccionado.

Nótese que la opción que aparece activada es precisamente la de utilizar como método de conversión la selección general usada por defecto para todas las operaciones (Use Eviews global default).

INCLUDEPICTURE "http://i25.photobucket.com/albums/c98/kmblog/200706/20070629a.jpg" \* MERGEFORMAT

INCLUDEPICTURE "http://i25.photobucket.com/albums/c98/kmblog/200706/20070629a.jpg" \* MERGEFORMAT

4.1. CARACTERIZACIÓN DE SERIES. ESTADÍSTICOS BÁSICOS Y CORRELOGRAMA

Como una primera etapa en la realización de una aplicación econométrica puede resultarnos de interés realizar una caracterización inicial de las variables a analizar, caracterización que puede comenzar con la simple representación gráfica de la serie, utilizando para ello las opciones generales de visualización (View) que se ofrecen en la ventana de los objetos tipo serie y que ya fueron comentadas en el primer apartado de esta guía.

Adicionalmente, y en ese mismo menú de visualización, Eviews ofrece una serie de posibilidades automatizadas para analizar o describir el comportamiento de una determinada serie.

Comenzando por las más sencillas, y seleccionando la opción de estadísticas descriptivas (Descriptive Stats) que se presenta en las opciones del menú de visualización (View) en la ventana del objeto serie, podremos optar, a su vez, entre dos tipos de estadísticas, el histograma de frecuencias y los estadísticos simples de la serie (Histogram and Stats), o las estadísticas clasificadas en función de otras variables (Stats by Clasiffication).

Eligiendo la primera de ellas, y utilizando la variable denominada SALER incluida en el workfile denominado TRIMES95 que ya hemos utilizado como ejemplo en otras ocasiones, el procedimiento descrito, que queda ilustrado en la figura, nos ofrecería los resultados que aparecen en la parte inferior derecha de la imagen.

Como puede comprobarse, la selección de estadísticas básicas incluye, además del histograma de frecuencias, el valor medio de la series (Mean), la mediana (Median), el máximo (Maximun) el Mínimo (Mínimun), la desviación típica (Std.Dev) así como los índices de apuntamiento (kewness) y curtosis (Kurtosis). Finalmente se presenta el valor del estadístico de Jarque-Bera, para contrastar la normalidad de la serie y su correspondiente nivel de probabilidad asociado, rechazándose la hipótesis nula de normalidad si dicha probabilidad es muy baja.

Seleccionando la segunda de las opciones ofrecidas, la de estadísticas clasificadas por otra serie o grupo de series, accederemos a un menú de selección donde deberemos indicar, la serie o grupo de series sobre las que queremos realizar la clasificación, así como el formato y los elementos de las tablas a generar, tal como se indica en la siguiente figura

En la pantalla de selección deberemos elegir, tanto los estadísticos a incluir en la tabla (Media, Suma, Mediana, Máximo, Mínimo, Desviación Típica, Apuntamiento y Curtosis), como la serie o grupo de series que sirven de base para la clasificación (en la imagen la serie IPCP), así como las opciones de mostrar los totales de la tabla.

Si la clasificación se ha realizado respecto a una única variable, los resultados obtenidos serán similares a los mostrados en la parte derecha de la imagen, donde se recogen los valores medios y de desviación típica de la serie SALER (% de crecimiento de salarios por persona), para distintos niveles de la serie IPC (% cto. de precios de consumo), distribuidos en tantos intervalos como hayamos seleccionado en el paso anterior (Max # of Bins), en este caso 5. El resto de opciones de visualización recogidas en el segundo bloque, nos ofrecen posibilidades alternativas de realización de contrastes estadísticos (Test for Descriptive Statistics), tanto simples (Simple Hypothesis Test), como complejas tipo ANOVA (Equality Test by Classification); elaboración de distintos tipos de gráficos de distribución (Distribution graphs), y tabulación acumulada (One-way Tabulation), remitiéndonos una vez más al manual del programa y la ayuda (Help), para la interpretación y utilización de estas opciones.

En la ventana del objeto tipo grupo, similar como decíamos a la del objeto serie, aparecen, además de las opciones anteriormente señaladas, dos alternativas adicionales de elaboración de estadísticos básicos, y que son la matriz de correlaciones (Correlations) y la matriz de covarianzas (Covariances), obteniéndose unos resultados como los que se muestran en esta figura, obtenidos sobre un grupo, denominado G1 que contiene tres variables (IPCP, IGDPM95 y SALER):

Finalizaremos este apartado dedicado al análisis descriptivo de series con el correlograma, que, recordamos, es la representación gráfica de los valores de autocorrelación de una variable.

Para obtener el correlograma de una determinada serie16, elegiremos la opción correspondiente (Correlogram), que aparece en el menú de visualización (View) de la ventana del objeto serie, y accederemos a una ventana de selección de opciones para el correlograma similar a la que aparece en la siguiente figura

5. GLOSARIO

ANALISIS DE REGRESION:

La regresión estadística o regresión a la media es la tendencia de una medición extrema a presentarse más cercana a la media en una segunda medición. La regresión se utiliza para predecir una medida basándonos en el conocimiento de otra.

ANALISIS DE LA VARIANZA:

es una colección de modelos estadísticos y sus procedimientos asociados, en el cual la varianza está particionada en ciertos componentes debidos a diferentes variables explicativas.

AUTOCORRELACION:

Es el momento en que se trabaja con un modelo de regresión multiple, donde se tiene que la primera variable vale 1 y esta acompañada por el termino dependiente.

CURTOSIS:

En teoría de la probabilidad y estadística, la curtosis es una medida de la forma. Así, las medidas de curtosis tratan de estudiar la proporción de la varianza que se explica por la combinación de datos extremos respecto a la media en contraposición con datos poco alejados de la misma. Una mayor curtosis implica una mayor concentración de datos muy cerca de la media de la distribución coexistiendo al mismo tiempo con una relativamente elevada frecuencia de datos muy alejados de la misma. Esto explica una forma de la distribución de frecuencias con colas muy elevadas y un con un centro muy apuntado.

ECONOMETRIA:

Es la ciencia social en la cual las herramientas de la teoría económica, las matemáticas y la inferencia estadística son aplicadas en el análisis de los fenómenos económicos.

ESTADISTICA INFERENCIAL:

La estadística inferencial es una parte de la estadística que comprende los métodos y procedimientos que por medio de la inducción determina propiedades de una población estadística, a partir de una pequeña parte de la misma.

FUNCIONES DE OBJETIVOS

Se definen explícitamente los objetivos del sistema y cómo se evaluarán, es una medida de la eficiencia del sistema.

HETEROSCEDASTICIDAD:

Este se presenta cuando no se cumple con la hipótesis de varianza constante para el término de la perturbación.

LOS PARÁMETROS

Son cantidades a las cuales se les asignar valores, una vez establecidos los parámetros, son constantes y no varían dentro de la simulación.

LAS RELACIONES FUNCIONALES

Muestran el comportamiento de las variables y parámetros dentro de un componente o entre componentes de un sistema. Estas características operativas pueden ser de naturaleza determinística o estocástica. Las relaciones determinísticas son identidades o definiciones que relacionan ciertas variables o parámetros, donde una salida de proceso es singularmente determinada por una entrada dada. Las relaciones estocásticas son aquellas en las que el proceso tiene de manera característica una salida indefinida para una entrada determinada.

LAS RESTRICCIONES

Son limitaciones impuestas a los valores de las variables o la manera en la cual los recursos pueden asignarse o consumirse.

MULTICOLINEALIDAD:

Determina si existe un alto grado de correlación lineal entre los diferentes tipos de variables independientes y dependientes.

PRUEBA DE HIPOTESIS:

Una prueba de hipótesis consiste en contrastar dos hipótesis estadísticas. Tal contraste involucra la toma de decisión acerca de las hipótesis. La decisión consiste en rechazar o no una hipótesis en favor de la otra. Una hipótesis estadística se denota por “H” y son dos:

- Ho: hipótesis nula- H1: hipótesis alternativa

SESGO:

Grado en el que el valor esperado de un estimador difiere del valor verdadero del parámetro.

VARIABLE ESTOCASTICA:

En probabilidad y estadística, una variable aleatoria o variable estocástica es una variable estadística cuyos valores se obtienen de mediciones en algún tipo de experimento aleatorio.

6. BIBLIOGRAFÍA

· Gujarati, Damodar (2004): “ECONOMETRÍA”. (4° edición). Mc Graw Hill

· Gujarati, Damodar (2000): “ECONOMETRÍA BASICA”. Mc Graw Hill

· Londoño Herrera, Carlos G. (2011): “ECONOMETRIA DE NEGOCIOS”. Universidad Remington

· Martinez Bencardino, Ciro (2003): “ESTADISTICA Y MUESTREO”. (11° edición) Ecoe Editores.

· Hansen Bruce (2012) “ECONOMETRICS”. UNIVERSITY OF WISCONSIN. LATEST REVISION JANUARY 2012.

· Mahia, Ramon (2001) GUIA DE MANEJO DEL PROGRAMA E- VIEWS.

· Perez Ramirez, Fredy (2009): ECONOMETRIA CONCEPTOS BASICOS (1ra edición) Ecoe Editores.

· Wooldridge, Jeffrey (2007) INTRODUCCION A LA ECONOMETRÍA, Un enfoque moderno. (2da edición) Thomson.

7. FUENTES DIGITALES O ELECTRÓNICAS

· www.wikipedia.com

· Parra Rodríguez. Francisco. Curso de econometría básica. Servicio de Estadísticas Económicas y Sociodemográficas. Instituto Cantabro de Estadística. ICANE

· http://www.uam.es/personal_pdi/economicas/sgarcia/Guia%20Eviews.pdf

� Como es habitual en muchas operaciones en entorno windows, podremos seleccionar varios objetos simultáneamente utilizando la tecla de "Mayúsculas" o "Control" combinadas con el botón izquierdo del ratón.

44

Related Documents